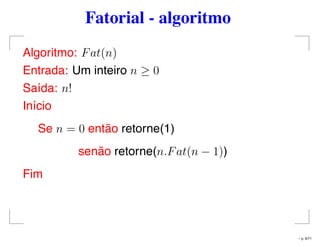

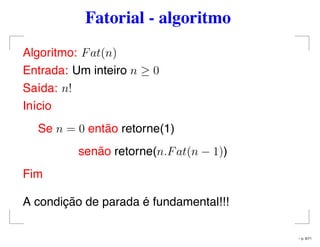

O documento discute algoritmos de recursividade, divisão e conquista, explicando conceitos fundamentais como fatorial, soma de números e algoritmos de busca binária. Ele também aborda métodos de ordenação como mergesort e quicksort, apresentando suas implementações e análises de complexidade. Através de exemplos e exercícios, o texto explora a eficácia e a natureza recursiva desses algoritmos.

![Soma de n números

Algoritmo: Soma(n, A)

Entrada: Um inteiro n > 0 e um vetor A[1..n]

Saída: O valor A1 + A2 + · · · + An

– p. 7/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-13-320.jpg)

![Soma de n números

Algoritmo: Soma(n, A)

Entrada: Um inteiro n > 0 e um vetor A[1..n]

Saída: O valor A1 + A2 + · · · + An

Início

Se n = 1 então retorne(A1)

Senão retorne(An + Soma(n − 1, A))

Fim

– p. 7/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-14-320.jpg)

![Exercícios

1. Escreva um algoritmo recursivo para determinar

o (um) maior elemento de um vetor A[1..n] de

inteiros.

– p. 8/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-15-320.jpg)

![Busca binária – recursivo

Algoritmo: Buscabin (l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: (“sim”, k) ou “não”

– p. 9/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-17-320.jpg)

![Busca binária – recursivo

Algoritmo: Buscabin (l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: (“sim”, k) ou “não”

Início

Se l > r então imprima “não”

– p. 9/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-18-320.jpg)

![Busca binária – recursivo

Algoritmo: Buscabin (l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: (“sim”, k) ou “não”

Início

Se l > r então imprima “não”

senão

k ← (l + r)/2 ;

Se x = Mk então imprima (“sim”, k)

– p. 9/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-19-320.jpg)

![Busca binária – recursivo

Algoritmo: Buscabin (l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: (“sim”, k) ou “não”

Início

Se l > r então imprima “não”

senão

k ← (l + r)/2 ;

Se x = Mk então imprima (“sim”, k)

senão se x > Mk então Buscabin (k + 1, r)

senão Buscabin (l, k − 1)

Fim

– p. 9/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-20-320.jpg)

![Busca binária – recursivo

Algoritmo: Buscabin (l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: (“sim”, k) ou “não”

Início

Se l > r então imprima “não”

senão

k ← (l + r)/2 ;

Se x = Mk então imprima (“sim”, k)

senão se x > Mk então Buscabin (k + 1, r)

senão Buscabin (l, k − 1)

Fim

Qual o tempo (pior caso) gasto pelo algoritmo?

– p. 9/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-21-320.jpg)

![Busca binária – recursivo

Algoritmo: Buscabin (l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: (“sim”, k) ou “não”

Início

Se l > r então imprima “não”

senão

k ← (l + r)/2 ;

Se x = Mk então imprima (“sim”, k)

senão se x > Mk então Buscabin (k + 1, r)

senão Buscabin (l, k − 1)

Fim

Qual o tempo (pior caso) gasto pelo algoritmo?

Resposta: O(log n)

– p. 9/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-22-320.jpg)

![Ordenação por intercalação – mergesort

Algoritmo: Ordinter(l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: A[l..r] em ordem não decrescente

– p. 11/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-24-320.jpg)

![Ordenação por intercalação – mergesort

Algoritmo: Ordinter(l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: A[l..r] em ordem não decrescente

Início

Se l = r então retorne(Al)

– p. 11/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-25-320.jpg)

![Ordenação por intercalação – mergesort

Algoritmo: Ordinter(l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: A[l..r] em ordem não decrescente

Início

Se l = r então retorne(Al)

senão

k ← (l + r)/2 ;

L1 ← Ordinter(1, k); L2 ← Ordinter(k + 1, j);

L3 ← Intercala(L1, L2);

retorne(L3)

Fim

– p. 11/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-26-320.jpg)

![Ordenação por intercalação – mergesort

Algoritmo: Ordinter(l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: A[l..r] em ordem não decrescente

Início

Se l = r então retorne(Al)

senão

k ← (l + r)/2 ;

L1 ← Ordinter(1, k); L2 ← Ordinter(k + 1, j);

L3 ← Intercala(L1, L2);

retorne(L3)

Fim

Qual o tempo gasto pelo algoritmo?

– p. 11/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-27-320.jpg)

![Ordenação por concatenação – quicksort

Algoritmo: Ordconc(l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: A[l..r] em ordem não decrescente

– p. 15/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-33-320.jpg)

![Ordenação por concatenação – quicksort

Algoritmo: Ordconc(l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: A[l..r] em ordem não decrescente

Início

Se l < r então

j ← Partição(l, r);

Ordconc(1, j − 1);

Ordconc(j + 1, r);

Fim

– p. 15/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-34-320.jpg)

![Ordenação por concatenação – quicksort

Algoritmo: Ordconc(l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: A[l..r] em ordem não decrescente

Início

Se l < r então

j ← Partição(l, r);

Ordconc(1, j − 1);

Ordconc(j + 1, r);

Fim

Qual o tempo (pior caso) gasto pelo algoritmo?

– p. 15/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-35-320.jpg)

![Ordenação por concatenação – quicksort

Algoritmo: Ordconc(l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: A[l..r] em ordem não decrescente

Início

Se l < r então

j ← Partição(l, r);

Ordconc(1, j − 1);

Ordconc(j + 1, r);

Fim

Qual o tempo (pior caso) gasto pelo algoritmo?

Resposta: O(n2). Porém, o tempo médio é O(n log n)

– p. 15/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-36-320.jpg)

![Quicksort – partição

Algoritmo: Partição(l, r)

Entrada: (l, r) representando A[l..r]

Saída: Um valor j tal que A[l..j − 1] são menores do que Aj

que, por sua vez, é menor ou igual a A[j + 1..r].

– p. 16/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-37-320.jpg)

![Quicksort – partição

Algoritmo: Partição(l, r)

Entrada: (l, r) representando A[l..r]

Saída: Um valor j tal que A[l..j − 1] são menores do que Aj

que, por sua vez, é menor ou igual a A[j + 1..r].

Início

j ← l; k ← r;

– p. 16/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-38-320.jpg)

![Quicksort – partição

Algoritmo: Partição(l, r)

Entrada: (l, r) representando A[l..r]

Saída: Um valor j tal que A[l..j − 1] são menores do que Aj

que, por sua vez, é menor ou igual a A[j + 1..r].

Início

j ← l; k ← r;

Enquanto (j < k) faça

– p. 16/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-39-320.jpg)

![Quicksort – partição

Algoritmo: Partição(l, r)

Entrada: (l, r) representando A[l..r]

Saída: Um valor j tal que A[l..j − 1] são menores do que Aj

que, por sua vez, é menor ou igual a A[j + 1..r].

Início

j ← l; k ← r;

Enquanto (j < k) faça

Enquanto (j < k) e (Aj ≤ Ak) faça k ← k − 1;

Se j < k então { Troca(Mj, Mk); j ← j + 1 }

– p. 16/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-40-320.jpg)

![Quicksort – partição

Algoritmo: Partição(l, r)

Entrada: (l, r) representando A[l..r]

Saída: Um valor j tal que A[l..j − 1] são menores do que Aj

que, por sua vez, é menor ou igual a A[j + 1..r].

Início

j ← l; k ← r;

Enquanto (j < k) faça

Enquanto (j < k) e (Aj ≤ Ak) faça k ← k − 1;

Se j < k então { Troca(Mj, Mk); j ← j + 1 }

Enquanto (Aj < Ak) faça j ← j + 1;

Se j < k então { Troca(Mj, Mk); k ← k − 1 }

retorne(j)

Fim

– p. 16/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-41-320.jpg)

![Quicksort – partição

Algoritmo: Partição(l, r)

Entrada: (l, r) representando A[l..r]

Saída: Um valor j tal que A[l..j − 1] são menores do que Aj

que, por sua vez, é menor ou igual a A[j + 1..r].

Início

j ← l; k ← r;

Enquanto (j < k) faça

Enquanto (j < k) e (Aj ≤ Ak) faça k ← k − 1;

Se j < k então { Troca(Mj, Mk); j ← j + 1 }

Enquanto (Aj < Ak) faça j ← j + 1;

Se j < k então { Troca(Mj, Mk); k ← k − 1 }

retorne(j)

Fim

Qual o tempo (pior caso) gasto pelo algoritmo?

– p. 16/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-42-320.jpg)

![Quicksort – partição

Algoritmo: Partição(l, r)

Entrada: (l, r) representando A[l..r]

Saída: Um valor j tal que A[l..j − 1] são menores do que Aj

que, por sua vez, é menor ou igual a A[j + 1..r].

Início

j ← l; k ← r;

Enquanto (j < k) faça

Enquanto (j < k) e (Aj ≤ Ak) faça k ← k − 1;

Se j < k então { Troca(Mj, Mk); j ← j + 1 }

Enquanto (Aj < Ak) faça j ← j + 1;

Se j < k então { Troca(Mj, Mk); k ← k − 1 }

retorne(j)

Fim

Qual o tempo (pior caso) gasto pelo algoritmo? O(r − l).

– p. 16/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-43-320.jpg)

![Exercícios

1. Execute o algoritmo partição no caso em que

todos os elementos do vetor A[l..r] são iguais

entre si. O que voce observa? Qual o valor de j

que o algoritmo devolve?

2. Exiba uma instância de pior caso do algoritmo

partição?

– p. 17/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-44-320.jpg)

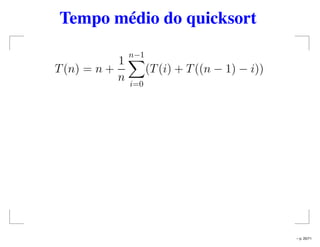

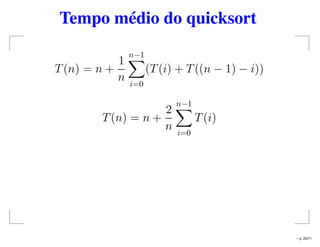

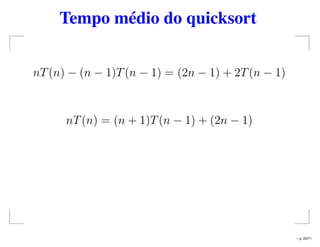

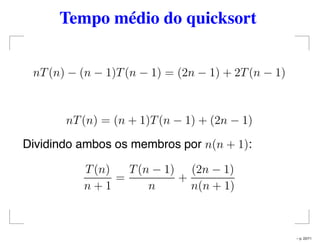

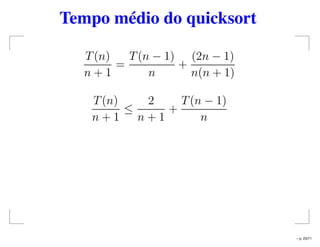

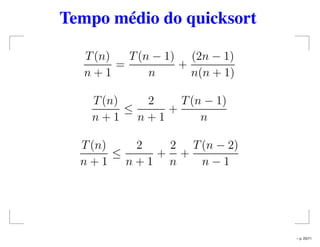

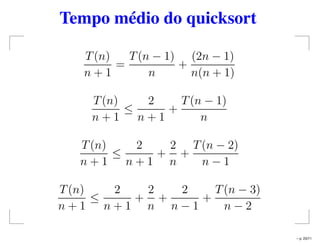

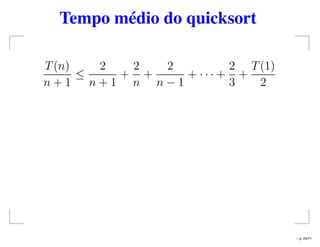

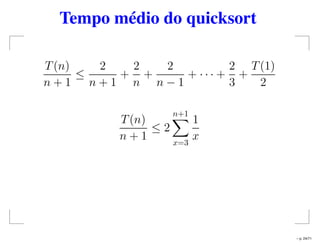

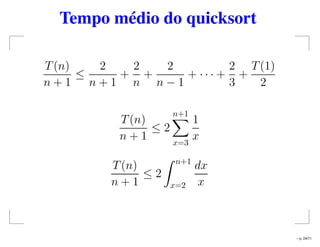

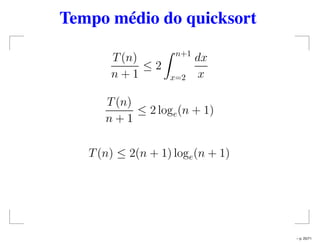

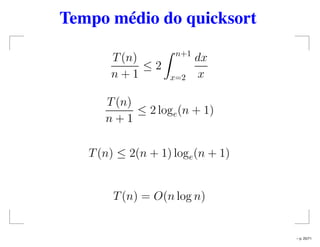

![Tempo médio do quicksort

Teorema: O tempo médio gasto pelo quicksort para

ordenar um vetor A[1..n] é O(n log n), supondo que

cada uma das n! permutações dos n elementos de

A tem a mesma probabilidade de ocorrer como

entrada.

– p. 19/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-46-320.jpg)

![Tempo médio do quicksort

Teorema: O tempo médio gasto pelo quicksort para

ordenar um vetor A[1..n] é O(n log n), supondo que

cada uma das n! permutações dos n elementos de

A tem a mesma probabilidade de ocorrer como

entrada.

Dem.: A rapidez média T(n) em questão pode ser

expressa pela seguinte recorrência:

– p. 19/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-47-320.jpg)

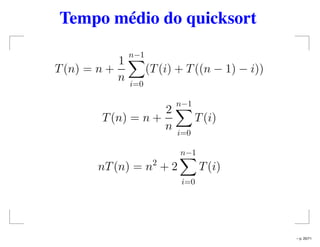

![Tempo médio do quicksort

Teorema: O tempo médio gasto pelo quicksort para

ordenar um vetor A[1..n] é O(n log n), supondo que

cada uma das n! permutações dos n elementos de

A tem a mesma probabilidade de ocorrer como

entrada.

Dem.: A rapidez média T(n) em questão pode ser

expressa pela seguinte recorrência:

T(n) = n +

1

n

n−1

i=0

(T(i) + T((n − 1) − i))

– p. 19/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-48-320.jpg)

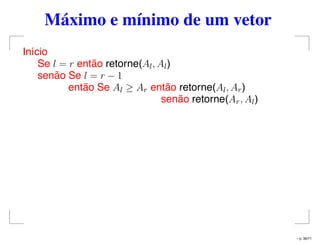

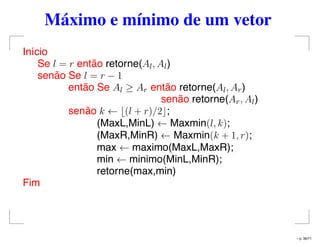

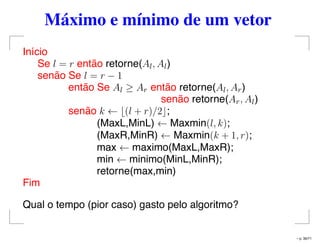

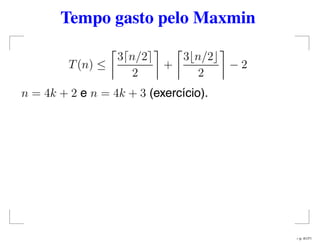

![Máximo e mínimo de um vetor

Algoritmo: Maxmin(l, r)

Entrada: Um par (l, r) representando A[l..r]

Saída: Um par (Ai, Aj) contendo o maior e o menor valor

de A[l..r]

– p. 35/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-89-320.jpg)

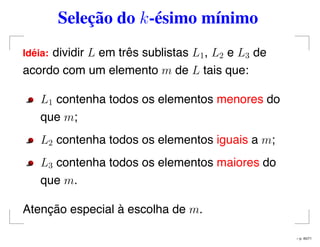

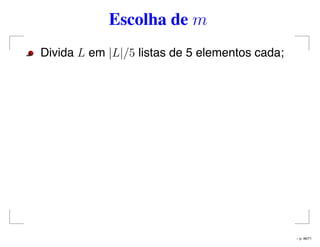

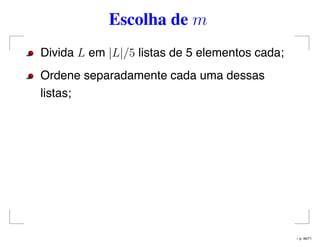

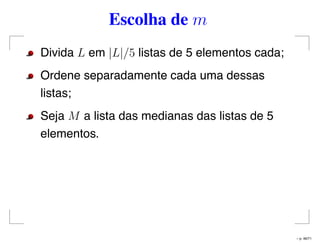

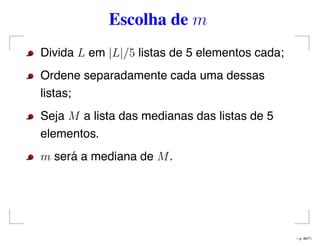

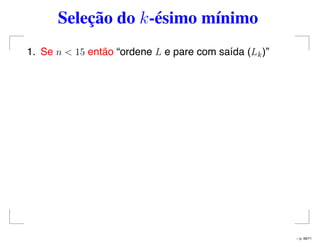

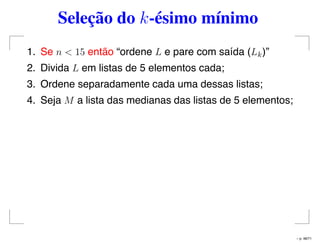

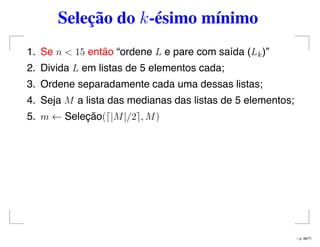

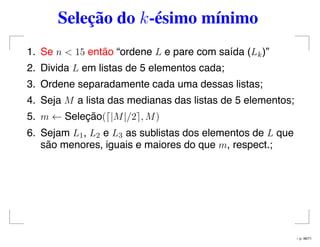

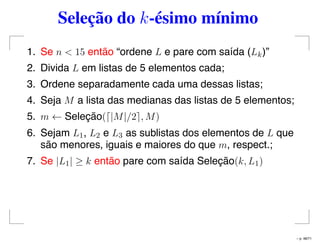

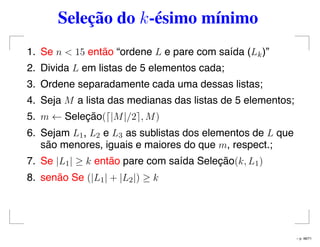

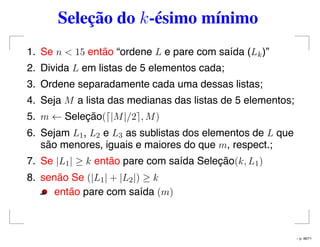

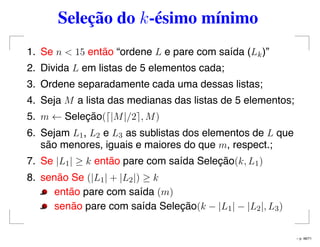

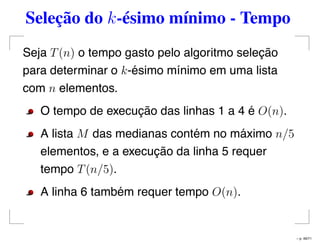

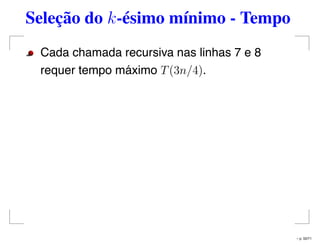

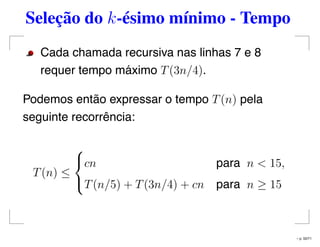

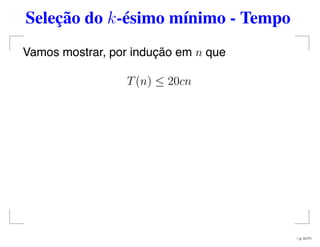

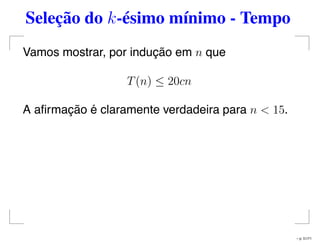

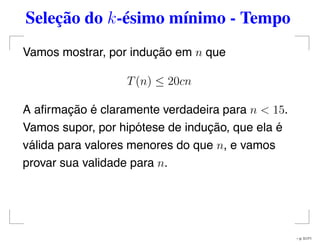

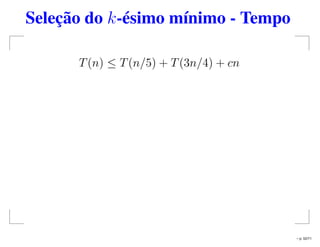

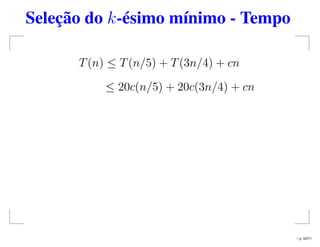

![Seleção do k-ésimo mínimo

Dado um vetor L[1 · · · n] com n elementos, escreva

um algoritmo para determinar o k-ésimo menor

elemento, para 1 ≤ k ≤ n.

– p. 44/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-111-320.jpg)

![Seleção do k-ésimo mínimo

Dado um vetor L[1 · · · n] com n elementos, escreva

um algoritmo para determinar o k-ésimo menor

elemento, para 1 ≤ k ≤ n.

Soluc¸ ˜ao: ordenar o vetor.

– p. 44/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-112-320.jpg)

![Seleção do k-ésimo mínimo

Dado um vetor L[1 · · · n] com n elementos, escreva

um algoritmo para determinar o k-ésimo menor

elemento, para 1 ≤ k ≤ n.

Soluc¸ ˜ao: ordenar o vetor. Tempo O(n log n).

– p. 44/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-113-320.jpg)

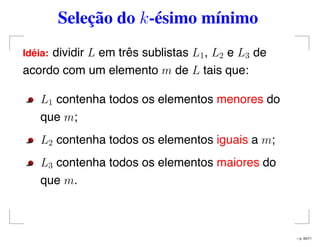

![Seleção do k-ésimo mínimo

Dado um vetor L[1 · · · n] com n elementos, escreva

um algoritmo para determinar o k-ésimo menor

elemento, para 1 ≤ k ≤ n.

Soluc¸ ˜ao: ordenar o vetor. Tempo O(n log n).

Utilizando a divisão e conquista, vamos projetar

um algoritmo linear.

– p. 44/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-114-320.jpg)

![Seleção do k-ésimo mínimo

Algoritmo: Seleção(k, L)

Entrada: Um inteiro k e um vetor L[1..n]

Saída: O k-ésimo menor elemento de L

– p. 47/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-121-320.jpg)

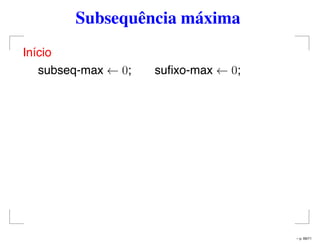

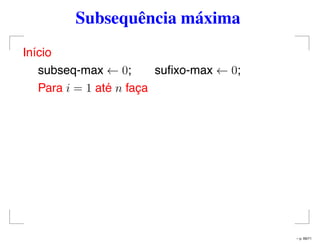

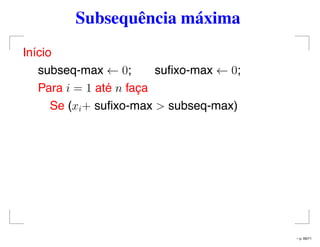

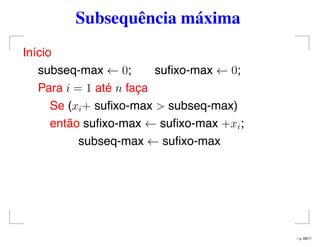

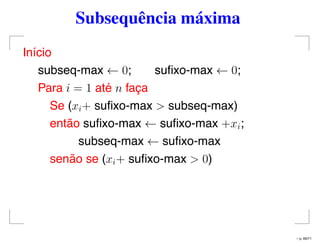

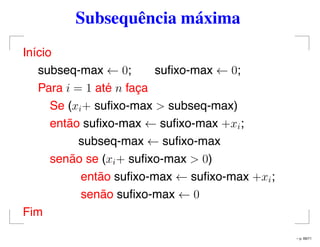

![Subsequência máxima

Algoritmo: Subseq-Max(L)

Entrada: Um vetor x[1..n]

Saída: O valor da subsequência máxima

– p. 68/71](https://image.slidesharecdn.com/6-recursividade-150324150508-conversion-gate01/85/Analise-de-Algoritmos-Recursividade-169-320.jpg)