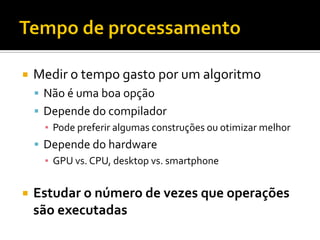

O documento discute conceitos de análise de algoritmos, incluindo:

1) Medidas de complexidade como tempo de processamento e uso de memória para comparar algoritmos;

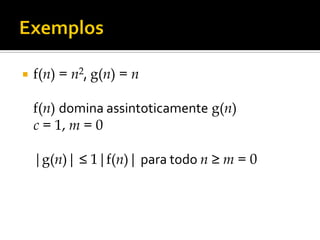

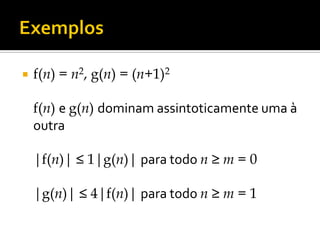

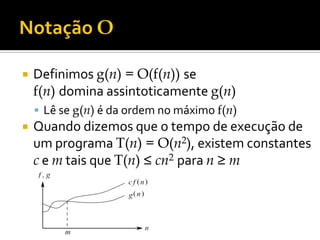

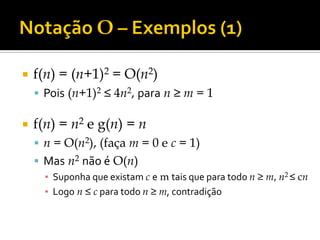

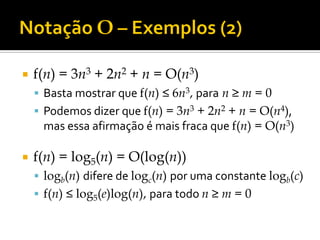

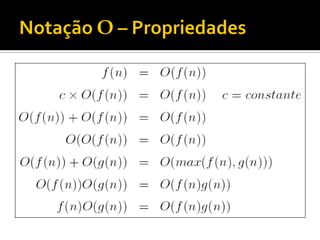

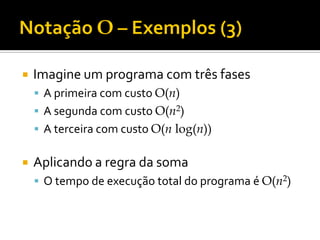

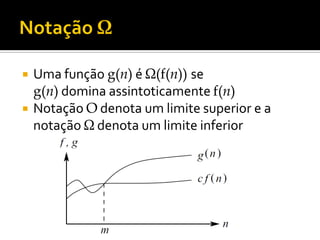

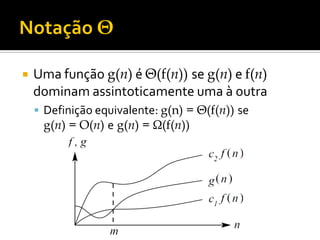

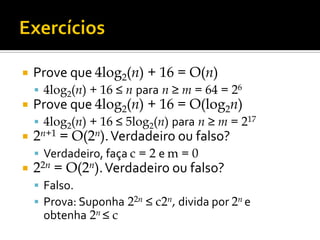

2) Notações como O(), Ω() e Θ() para classificar algoritmos de acordo com sua complexidade assintótica;

3) Exemplos de algoritmos com diferentes complexidades como constante, logarítmica, linear, quadrática e exponencial.

![ Achar o máximo de um vetor

Complexidade: f(n) = n-1

Esse algoritmo é ótimo

int vmax(int *vec, int n) {

int i;

int max = vec[0];

for(i = 1; i < n; i++) {

if(vec[i] > max) {

max = vec[i];

}

}

return max;

}

-

-

1

n-1

n-1

A < n-1

n-1

n-1

1](https://image.slidesharecdn.com/complexity-240214125711-c80a6e8b/85/Artigo-sobre-complexibilidade-complexity-pdf-4-320.jpg)

![ Problema: encontrar o valores minimo e

máximo em um vetor

void minmax(int *vec, int n, int *min, int *max) {

int i;

int *min = vec[0];

int *max = vec[0];

for(i = 1; i < n; i++) {

if(vec[i] < *min) {

*min = vec[i];

}

if(vec[i] > *max) {

*max = vec[i];

}

}

}

-

-

1

1

n-1

n-1

A < n-1

-

n-1

B < n-1

-

-

-

melhor caso: f(n) = 2(n-1)

pior caso: f(n) = 2(n-1)

caso médio: f(n) = 2(n-1)](https://image.slidesharecdn.com/complexity-240214125711-c80a6e8b/85/Artigo-sobre-complexibilidade-complexity-pdf-7-320.jpg)

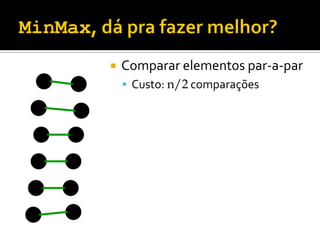

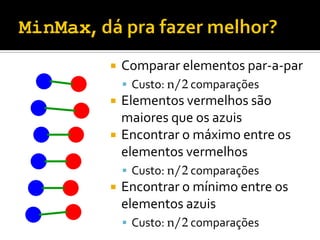

![ Se vec[i] < *min, então não precisamos

checar se vec[i] > *max

void minmax2(int *vec, int n, int *min, int *max) {

int i;

int *min = vec[0];

int *max = vec[0];

for(i = 1; i < n; i++) {

if(vec[i] < *min) {

*min = vec[i];

} else {

if(vec[i] > *max) {

*max = vec[i];

}

}

}

}

-

-

1

1

n-1

n-1

A < n-1

-

n-1-A

B < n-1-A

-

-

-

-

melhor caso:

(decrescente)

f(n) = n-1

pior caso:

(crescente)

f(n) = 2(n-1)

caso médio:

(aleatório)

f(n) > 3(n-1)/2](https://image.slidesharecdn.com/complexity-240214125711-c80a6e8b/85/Artigo-sobre-complexibilidade-complexity-pdf-8-320.jpg)

![void minmax3(int *vec, int n, int *min, int *max) {

int i;

int *min = INT_MAX;

int *max = INT_MIN;

for(i = 0; i < n; i += 2) {

if(vec[i] < vec[i+1]) {

a = i; v = i+1;

} else {

a = i+1; v = i;

}

if(vec[a] < *min)

*min = vec[a];

if(vec[v] > *max)

*max = vec[v];

}

}

-

-

1

1

n/2

n/2

n/4

-

n/4

-

n/2

A < n/2

n/2

B < n/2

-

-

melhor caso:

f(n) = 3n/2

pior caso:

f(n) = 3n/2

caso médio:

f(n) = 3n/2

Algoritmo ótimo](https://image.slidesharecdn.com/complexity-240214125711-c80a6e8b/85/Artigo-sobre-complexibilidade-complexity-pdf-11-320.jpg)

![ Encontre o menor valor no vetor

Troque-o com o primeiro elemento V[0]

Repita os passos acima com os n-1 itens

restantes, depois com os n-2 restantes, até

que reste apenas 1](https://image.slidesharecdn.com/complexity-240214125711-c80a6e8b/85/Artigo-sobre-complexibilidade-complexity-pdf-54-320.jpg)

![void ordena(int *V, int n){

int i, j, min, x;

for(i = 0; i < n - 1; i++) {

min = i;

for(j = i + 1; j < n; j++)

if(V[j] < V[min])

min = j;

/* troca A[min] e A[i]: */

x = V[min];

V[min] = V[i];

V[i] = x;

}

}

-

-

n-1

n-1

?

?

?

-

n-1

n-1

n-1

-

-

-

-

n-1

n-1

n(n-1)/2

n(n-1)/2

A < n(n-1)/2

-

n-1

n-1

n-1

-

- Qual a complexidade assintótica

do número de comparações?](https://image.slidesharecdn.com/complexity-240214125711-c80a6e8b/85/Artigo-sobre-complexibilidade-complexity-pdf-55-320.jpg)

![// A, B e C sao vetores globais

void e1(int n){

int i, j, k;

for(i = 0; i < n; i++)

for(j = 0; j < n; j++) {

C[i][j] = 0;

for(k = n-1; k >= 0; k--) {

C[i][j] = C[i][j] +

A[i][k] * B[k][j];

}

}

}

}

O que faz essa função? Qual sua

complexidade assintótica?

-

-

-

n

n*n

n*n

n*n*n

n*n*n

-

-

-

-](https://image.slidesharecdn.com/complexity-240214125711-c80a6e8b/85/Artigo-sobre-complexibilidade-complexity-pdf-56-320.jpg)