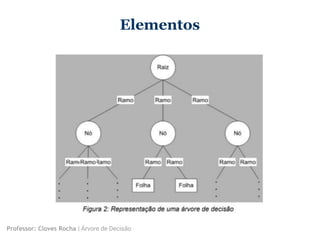

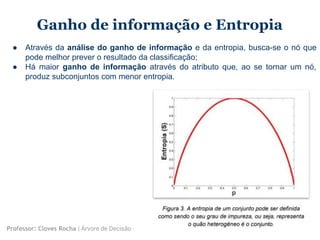

O documento apresenta uma introdução às árvores de decisão, descrevendo-as como modelos estatísticos que classificam e preveem dados através de divisões recursivas. Os principais pontos abordados são: os elementos básicos de uma árvore de decisão, como nós, ramos e regras; algoritmos comuns como CART, ID3 e C4.5; e aplicações como diagnóstico médico e análise de crédito.