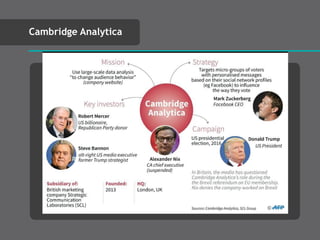

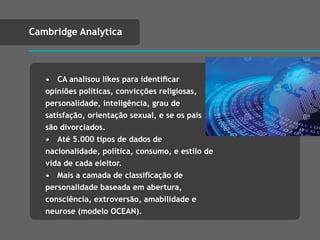

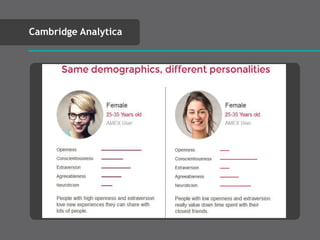

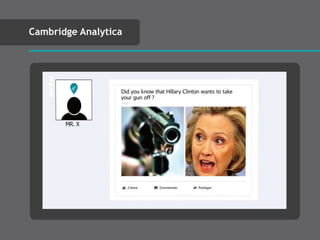

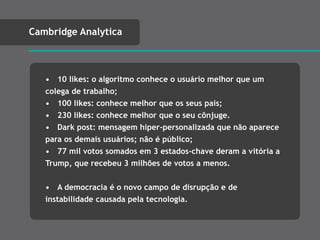

O documento analisa o papel do marketing digital e das redes sociais como instrumentos de controle na sociedade moderna, destacando a vigilância algorítmica e suas implicações éticas. Ele discute a utilização de dados pessoais para influenciar comportamentos, exemplificado pela atuação da Cambridge Analytica nas eleições, e a emergência de novos gatekeepers algorítmicos. Além disso, aborda as consequências da era digital, como a desinformação e a polarização, que desafiam a liberdade de expressão.