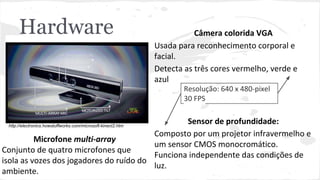

O Kinect é um dispositivo da Microsoft que combina câmeras, microfones e software para reconhecer movimentos corporais e voz sem a necessidade de controles. Ele usa luz infravermelha e sensores para mapear a profundidade e identificar a posição do corpo através de aprendizado de máquina.

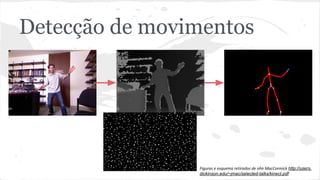

![Profundidade a partir do Stereo

Ao capturar a cena por outro ângulo, os

objetos que estão mais próximos são mais

deslocados que os que estão longe.

Kinect captura e observa a cena de ângulos

diferentes, e infere a profundidade pela

análise do deslocamento no padrão de

salpicamento

[ M. Domínguez-Morales, A. Jiménez-Fernández, R. Paz-

Vicente, A. Linares-Barranco, G. Jiménez-Moreno, 2012 ]](https://image.slidesharecdn.com/seminariokinectmm1-141112095426-conversion-gate01/85/Seminario-Kinect-11-320.jpg)

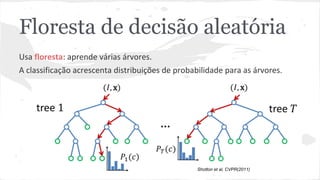

![Floresta de decisão aleatória

Tempo de aprendizado:

1 CPU: 24000 horas.

Implementação distribuída: apenas 1 dia.

● 3 árvores com profundidade 20.

● 1 milhão de imagens.

● 1000 núcleos.

[Shotton et al, CVPR(2011)]](https://image.slidesharecdn.com/seminariokinectmm1-141112095426-conversion-gate01/85/Seminario-Kinect-19-320.jpg)