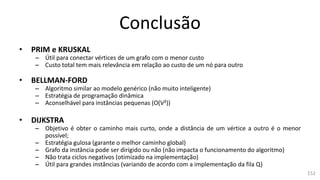

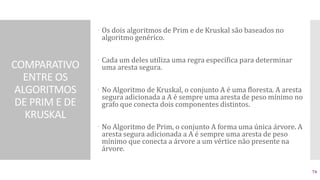

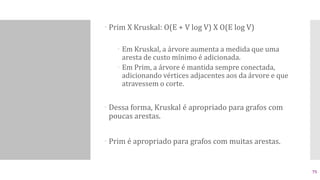

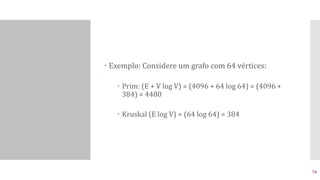

O documento apresenta uma introdução sobre árvores espalhadas mínimas e descreve dois algoritmos para encontrar tal árvore em um grafo: o algoritmo de Prim e o algoritmo de Kruskal. O documento discute o funcionamento, análise de complexidade e corretude de cada algoritmo e faz uma comparação entre eles.

![ O algoritmo mantém durante sua execução as seguintes

informações:

- Todos os vértices que não estão na árvore, estão em uma fila de

prioridade (mínima) Q.

- Cada vértice v em Q possui uma chave[v] que indica o menor

custo de qualquer aresta ligando v a algum vértice da árvore. Se

não existir nenhuma aresta, então chave[v] = ∞

37](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-37-320.jpg)

![AGM-PRIM(G, w, r )

1 para cada u ∈ V[G] faça

2 chave[u] ← ∞

3 pai[u] ← NULL

4 chave[r ] ← 0

5 Q ← V[G]

6 enquanto Q ≠ Ø faça

7 U ← EXTRAIRMÍNIMO(Q)

8 para cada v ∈ Adjacente[u] faça

9 se v ∈ Q e w(u, v) < chave [v]

10 então pai[v] ← u

11 chave[v] ← w(u, v)

12 retorne pai

38](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-38-320.jpg)

![ALGORITMO

DE PRIM

Análise de

Complexidade

Calculando o tempo de execução do Algoritmo de Prim no pior caso,

tem-se:

1 para cada u ∈ V[G] faça O(V)

2 chave[u] ← ∞ O(1) O(V)

3 pai[u] ← NULL O(1)

4 chave[r ] ← 0 O(1)

5 Q ← V[G] O(V)

Portanto, a complexidade do laço mais externo é:

O(V) + O(1) + O(V) = O(V) + O(V)

39](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-39-320.jpg)

![6 enquanto Q ≠ Ø faça O(V)

7 U ← EXTRAIRMÍNIMO(Q) O(log V)

8 para cada v ∈ Adjacente[u] faça

9 se v ∈ Q e w(u, v) < chave [v] O(E)

10 então pai[v] ← u

11 chave[v] ← w(u, v) O(log V)

12 retorne pai O(1)

Portanto, a complexidade total do algoritmo é:

-> O(V) + O(V) + O(V).O(log V) + O(E).O(log V) =

-> O(V log V) + (E log V) =

-> O(E log V)

40](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-40-320.jpg)

![ALGORITMO

DE PRIM

Análise de

Corretude

Etapa 1: Prova do critério de Parada Externa

Linha 1: todos os vértices v ∈ V[G] são percorridos.

Portanto, a execução é interrompida quando todos os

vértices são percorridos.

Etapa 2: Prova do critério de parada (laço interno)

Linha 6 (Critério de parada): Q ≠ Ø

Linhas 2, 3, 4 e 5 (inicialização): chave[u] ← 1; pai[u] ←

NULL; chave[r ] ← 0; Q ← V[G]

Portanto, a execução será interrompida quando Q = Ø

(lista vazia).

43](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-43-320.jpg)

![ Etapa 3: Inicialização

O algoritmo mantém o seguinte laço invariante de 3

partes nas linhas de 1 a 5:

A = {(v, pai[v]): v ∈ V – {r} – Q}

Os vértices já colocados na MST são aqueles em V – Q.

Para todos os vértices v ∈ Q, se pai[v] ≠ NULL, então

chave[v] é o peso de uma aresta leve (v, pai[v]) que

conecta v a algum vértice já inserido na MST.

44](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-44-320.jpg)

![ Etapa 4: Manutenção

Linha 7: identifica vértice u ∈ Q incidente em uma

aresta que cruza o corte (V-Q, Q). A remoção de u do

conjunto Q o acrescenta ao conjunto V-Q de vértices

na árvore, adicionando assim, (u, pai[u]) em A.

Linhas 8-11: o for atualiza os campos chave e pai de

cada vértice v adjacente a u.

45](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-45-320.jpg)

![ Etapa 5: Término

Linhas 6-11: Para todos os vértices v ∈ Q, se pai[v] ≠

NULL, então chave[v] é o peso da aresta (v, pai[v])

que conecta v a algum vértice já inserido na MST.

Portanto, corretude garantida: uma MST é gerada.

46](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-46-320.jpg)

![MST-KRUSKAL(G,w)

1 A := {}

2 para cada vértice v em V[G] faça

3 MAKE-SET(v)

4 Ordene as arestas de E em ordem crescente de peso (w)

5 para cada aresta (u,v), tomadas em ordem crescente de peso (w) faça

6 se FIND-SET(u) != FIND-SET(v)

7 então A := A união {(u,v)}

8 UNION(u,v)

9 return A

65](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-65-320.jpg)

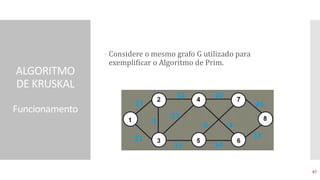

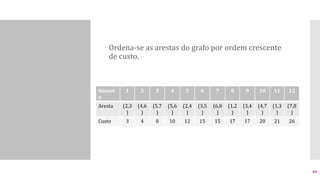

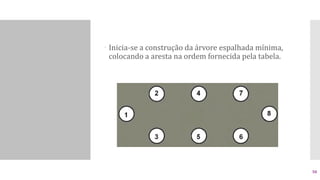

![ALGORITMO

DE KRUSKAL

Análise de

Complexidade

Calculando o tempo de execução do Algoritmo de Kruskal no pior caso,

tem-se:

1 A := {} O(1)

2 para cada vértice v em V[G] faça

3 MAKE-SET(v) O(V)

4 Ordene as arestas de E em ordem crescente de peso (w) O(E log E)

67](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-67-320.jpg)

![ALGORITMO

DE KRUSKAL

Análise de

Corretude

Etapa 1: Prova do Critério de Parada Externa

Linha 2: todos os vértices v ∈ V[G] são percorridos.

Portanto, a execução é interrompida quando todos os

vértices são percorridos.

Etapa 2: Prova do Critério de parada (laço interno)

Linha 5 (Critério de parada): cada aresta (u,v), tomadas

em ordem crescente de peso (w)

Linha 1 (inicialização): A:={}

Portanto, a execução será interrompida quando todas as

arestas tiverem sido ordenadas em ordem crescente.

69](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-69-320.jpg)

![Caminho Mínimo de Única Origem

Inicialização:

INICIALIZAÇÃO(G, s)

PARA cada vértice v ∈ V[G] FAÇA

v.d = ∞

v.π = NIL

s.d = 0

• Para cada vértice v ∈ V, mantemos um atributo v.d, que é um limite superior para o

peso de um caminho mínimo de s a v;

• Denominamos v.d uma estimativa de caminho mínimo;

– Ele indica que o algoritmo encontrou até aquele momento um caminho de s a v com peso v.d.

• Após a inicialização, temos:

– v.π = NIL, para todo v ∈ V,

– s.d = 0

– v.d = ∞, para v ∈ V – {s}

92](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-92-320.jpg)

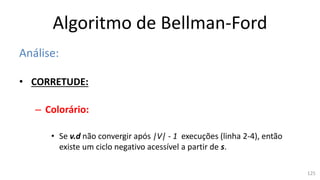

![Algoritmo de Bellman-Ford

Algoritmo:

Bellman-Ford(G, w, s)

1 INICIALIZAÇÃO(G, s)

2 para i = 1 até |V[G]|-1 faça

3 para cada aresta (u,v) ∈ E[G] faça

4 RELAXAMENTO(u, v, w)

5 para cada aresta (u,v) ∈ E[G] faça

7 se v.d > v.u + w(u,v) então

8 retorna FALSO

9 retorna VERDADEIRO

119](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-119-320.jpg)

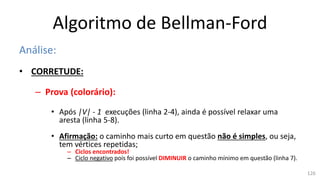

![Algoritmo de Bellman-Ford

Análise:

• COMPLEXIDADE:

Bellman-Ford(G, w, s)

1 INICIALIZAÇÃO(G, s)

2 para i = 1 até |V[G]|-1 faça

3 para cada aresta (u,v) ∈ E[G] faça

4 RELAXAMENTO(u, v, w)

5 para cada aresta (u,v) ∈ E[G] faça

7 se v.d > v.u + w(u,v) então

8 retorna FALSO

9 retorna VERDADEIRO

O(V)

O((V-1) * E)

O(E)

O(1)

Critério: T(n)

127](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-127-320.jpg)

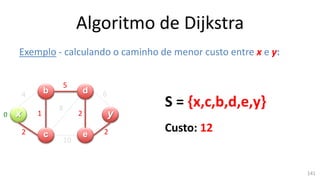

![Algoritmo de Dijkstra

Exemplo - calculando o caminho de menor custo entre x e y:

x y

b

c

d

e

4

2

1

5

10

2

8

6

2

Etapa S d[x] d[b] d[c] d[d] d[e] d[y]

1 Ø ∞ ∞ ∞ ∞ ∞ ∞

134](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-134-320.jpg)

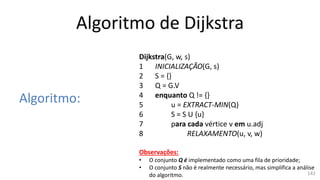

![Algoritmo de Dijkstra

Exemplo - calculando o caminho de menor custo entre x e y:

x y

b

c

d

e

4

2

1

5

10

2

8

6

2

Etapa S d[x] d[b] d[c] d[d] d[e] d[y]

1 Ø ∞ ∞ ∞ ∞ ∞ ∞

2 {x} 0 4 2 ∞ ∞ ∞

0

135](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-135-320.jpg)

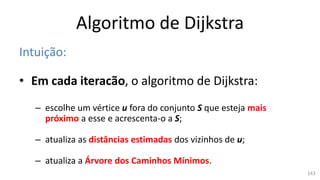

![Algoritmo de Dijkstra

Exemplo - calculando o caminho de menor custo entre x e y:

x y

b

c

d

e

4

2

1

5

10

2

8

6

2

Etapa S d[x] d[b] d[c] d[d] d[e] d[y]

1 Ø ∞ ∞ ∞ ∞ ∞ ∞

2 {x} 0 4 2 ∞ ∞ ∞

3 {x,c} 2 3 0 10 12 ∞

0

136](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-136-320.jpg)

![Algoritmo de Dijkstra

Exemplo - calculando o caminho de menor custo entre x e y:

x y

b

c

d

e

4

2

1

5

10

2

8

6

2

Etapa S d[x] d[b] d[c] d[d] d[e] d[y]

1 Ø ∞ ∞ ∞ ∞ ∞ ∞

2 {x} 0 4 2 ∞ ∞ ∞

3 {x,c} 2 3 0 10 12 ∞

4 {x,c,b} * 0 * 8 ∞ ∞

0

137](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-137-320.jpg)

![Algoritmo de Dijkstra

Exemplo - calculando o caminho de menor custo entre x e y:

x y

b

c

d

e

4

2

1

5

10

2

8

6

2

Etapa S d[x] d[b] d[c] d[d] d[e] d[y]

1 Ø ∞ ∞ ∞ ∞ ∞ ∞

2 {x} 0 4 2 ∞ ∞ ∞

3 {x,c} 2 3 0 10 12 ∞

4 {x,c,b} * 0 * 8 ∞ ∞

5 {x,c,b,d} * * * 0 10 14

0

138](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-138-320.jpg)

![Algoritmo de Dijkstra

Exemplo - calculando o caminho de menor custo entre x e y:

x y

b

c

d

e

4

2

1

5

10

2

8

6

2

Etapa S d[x] d[b] d[c] d[d] d[e] d[y]

1 Ø ∞ ∞ ∞ ∞ ∞ ∞

2 {x} 0 4 2 ∞ ∞ ∞

3 {x,c} 2 3 0 10 12 ∞

4 {x,c,b} * 0 * 8 ∞ ∞

5 {x,c,b,d} * * * 0 10 14

6 {x,c,b,d,e} * * * * 0 12

0

139](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-139-320.jpg)

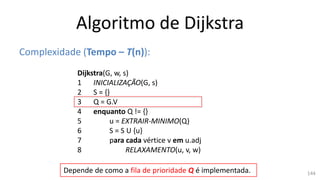

![Algoritmo de Dijkstra

Exemplo - calculando o caminho de menor custo entre x e y:

x y

b

c

d

e

4

2

1

5

10

2

8

6

2

Etapa S d[x] d[b] d[c] d[d] d[e] d[y]

1 Ø ∞ ∞ ∞ ∞ ∞ ∞

2 {x} 0 4 2 ∞ ∞ ∞

3 {x,c} 2 3 0 10 12 ∞

4 {x,c,b} * 0 * 8 ∞ ∞

5 {x,c,b,d} * * * 0 10 14

6 {x,c,b,d,e} * * * * 0 12

7 {x,c,b,d,e,y} * * * * * 0

0

140](https://image.slidesharecdn.com/seminrio-rvoresespalhadasmnimas-diegocavalcaelayla-151001155436-lva1-app6891/85/Arvores-Espalhadas-Minimas-140-320.jpg)