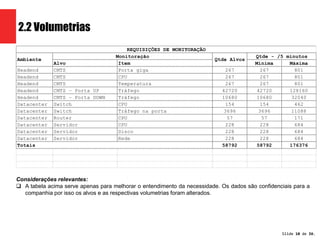

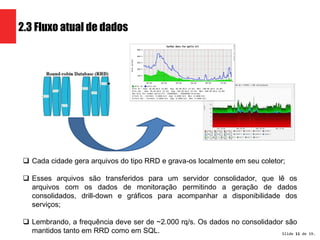

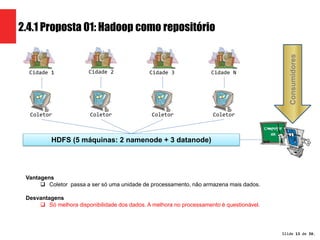

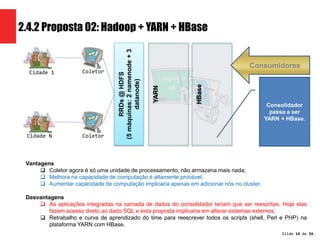

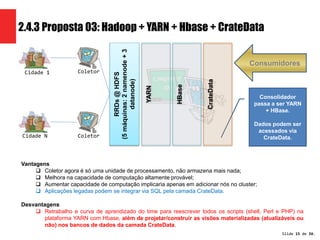

A apresentação propõe três arquiteturas Hadoop para processar dados de monitoramento de rede de uma empresa de telecomunicações. A proposta 3, que usa Hadoop, HBase, YARN e CrateData, é a escolhida por oferecer maior capacidade de processamento e não impactar sistemas legados.