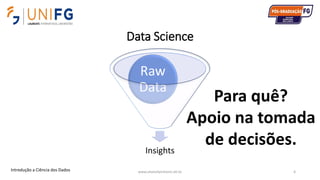

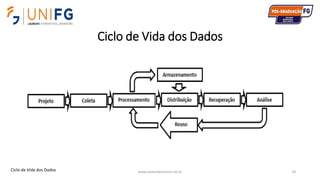

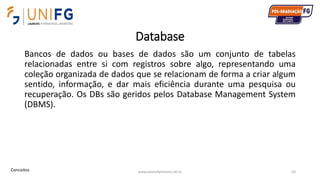

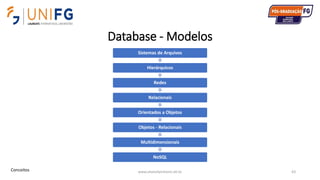

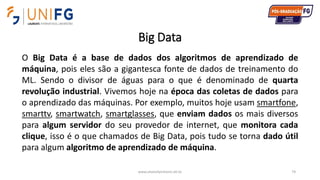

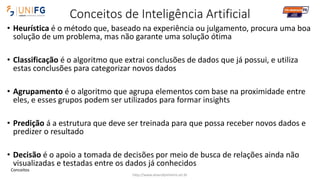

O documento fornece informações sobre uma disciplina de Data Science ministrada pelo professor Álvaro Pinheiro. A ementa inclui tópicos como introdução à ciência de dados, conceitos sobre dados, ciclo de vida dos dados, valor da informação, privacidade e ética. O documento também fornece referências bibliográficas sobre o tema.

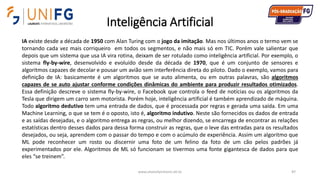

![FUZZY

www.alvarofpinheiro.eti.br 119

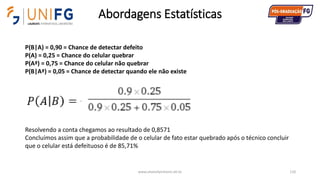

Etapa na qual os valores numéricos são transformados em graus

de pertinência para um valor linguístico através da função de

pertinência. Engloba a Análise do Problema, Definição das

Variáveis, Definição das Funções de pertinência e Criação das

Regiões. Podendo ser aplicado em: Controladores de Processos

Industriais e a igualdade entre sistemas lineares e não

lineares; Sistemas Especialistas e flexibilidade; Redes

Neurais e sua capacidade de aprendizado.

u: [0,1]](https://image.slidesharecdn.com/datascience-181202160711/85/Data-science-119-320.jpg)