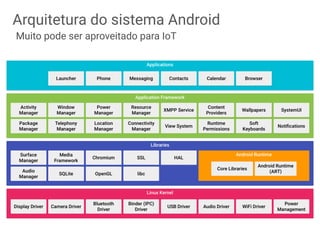

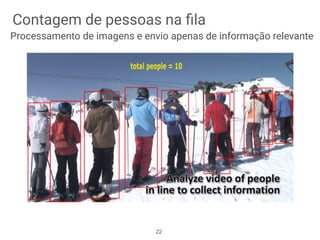

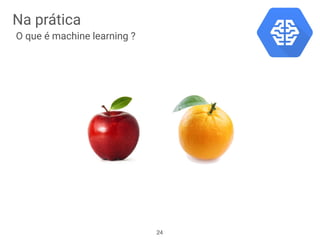

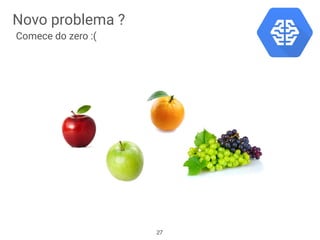

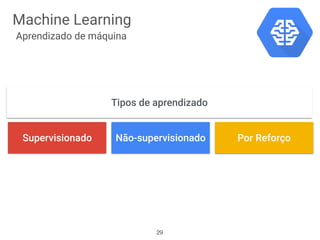

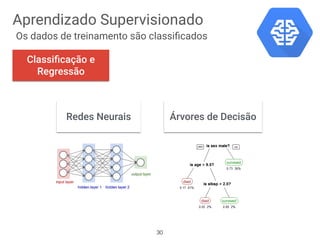

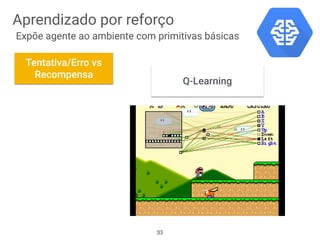

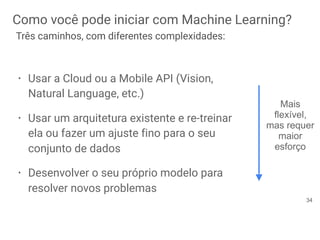

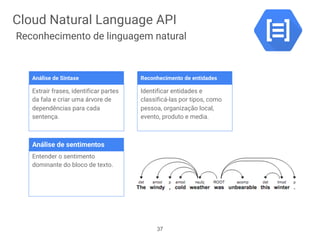

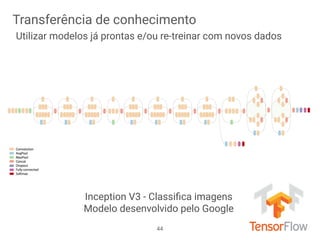

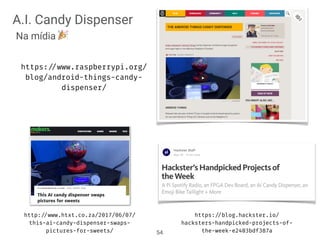

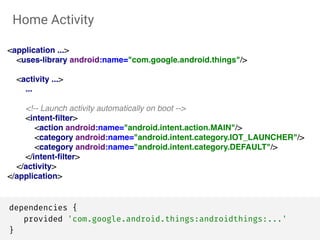

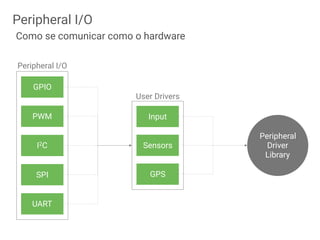

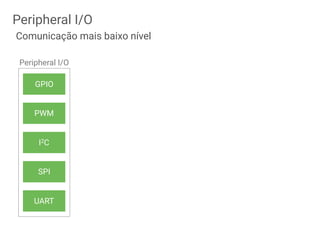

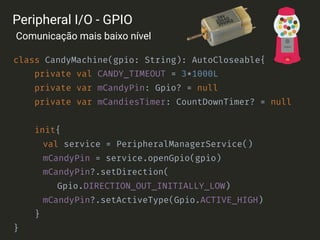

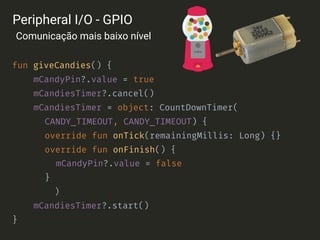

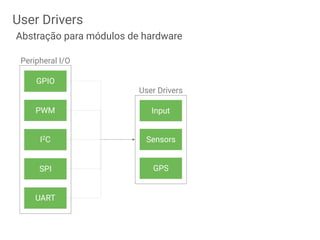

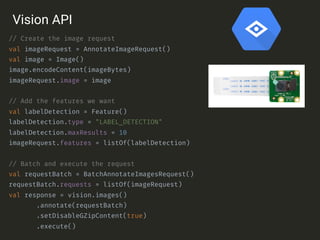

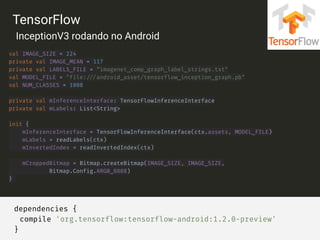

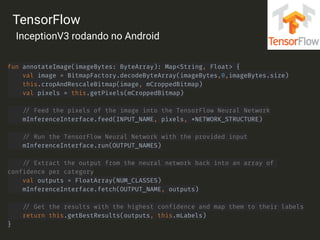

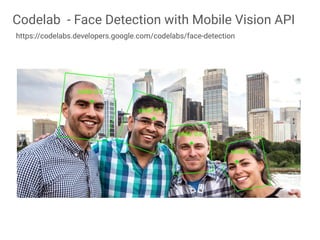

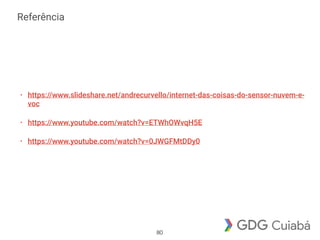

O documento apresenta uma visão geral sobre o uso de Android Things e Machine Learning em aplicações de Internet das Coisas, destacando a construção de uma máquina de doces inteligente. Ele detalha conceitos de aprendizado de máquina, tipos de algoritmos e fornece exemplos práticos de implementação e integração com APIs do Google. Além disso, inclui referências a projetos e recursos para desenvolvedores interessados na criação de soluções IoT.