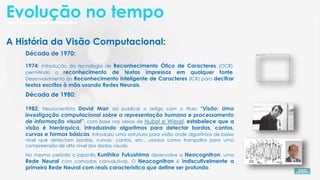

O documento discute a evolução da visão computacional, abordando desde os fundamentos de ciência de dados e inteligência artificial até suas aplicações práticas em diversos setores. Destaca marcos históricos, como o desenvolvimento de tecnologias de processamento de imagem e redes neurais convolucionais, e termina enfatizando o impacto crescente da visão computacional em áreas como diagnósticos médicos e veículos autônomos. O mercado de visão computacional é projetado para crescer significativamente, refletindo sua versatilidade e importância crescente.

![Referências:

BARONE, Dante; BOESING, Ivan. Inteligência Artificial: Diálogos entre Mentes e Máquinas. 1ª. ed. [S. l.]: Age, 2015.

309p.

AFTD, Equipe. Cientista revolucionário da computação Russell Kirsch morre após jornada com FTD. AFTD, 2020.

Disponível em: https://www.theaftd.org/pt/posts/front-page/revolutionary-computer-scientist-russell-kirsch-dies-

after-journey-with-ftd/. Acesso em: 28 de dezembro de 2023.

CAPITAL, Equipe Faster. Visão computacional permitindo que a AAI perceba e compreenda imagens.

FasterCapital, 2023. Disponível em: https://fastercapital.com/pt/contente/Visao-computacional--permitindo-

que-a-AAI-perceba-e-compreenda-imagens.html. Acesso em: 03 de janeiro de 2024.

DIAS, Fabricio A. O que é reconhecimento óptico de caracteres? Benefícios e onde usar. Lecom, 2023.

Disponível em: https://www.lecom.com.br/blog/o-que-reconhecimento-optico-caracteres/. Acesso em: 01 de

janeiro de 2024.

ECONOMIST, Equipe The. Do não trabalho à rede neural. The Economist, 2016. Disponível em:

https://www.economist.com/special-report/2016/06/23/from-not-working-to-neural-networking. Acesso em: 28 de

dezembro de 2023.

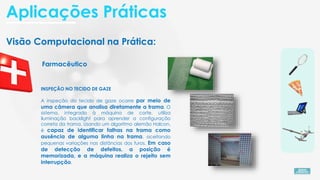

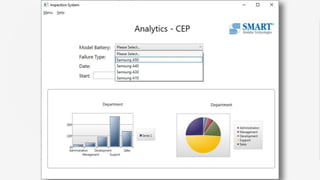

COSTA, André Luiz Amaral Teixeira; MALISANO, Giovanni. SMARTM - PAD PRINTER. In: V Seminário de Avaliação

de Pesquisa Científica e Tecnológica (SAPCT) e IV Workshop de Integração e Capacitação em Processamento

de Alto Desempenho (ICPAD) - Centro Universitário SENAI CIMATEC, 2020. Disponível em:

https://www.doity.com.br/anais/sapct-icpad-2020/trabalho/140972. Acesso em: 07/01/2024 às 17:40.](https://image.slidesharecdn.com/visocomputacional2024-cimatec-240531034933-5ecd916d/85/Visao-Computacional-2024-SENAI-CIMATEC-50-320.jpg)

![Referências:

GLANDCHUK, Veronika. A história do aprendizado de máquina: como tudo começou?. Label Your Data, 2020.

Disponível em: https://labelyourdata.com/articles/history-of-machine-learning-how-did-it-all-start. Acesso em: 30

de dezembro de 2023.

INTELLIGENCE, Equipe Mordor. Tamanho do mercado de visão computacional e análise de ações – Tendências

e previsões de crescimento (2023 – 2028). Mordor Intelligence, 2023. Disponível em:

https://www.mordorintelligence.com/pt/industry-reports/computer-vision-market. Acesso em: 04 de janeiro de

2024.

ID, Equipe Crypto. Visão computacional: O que é? Como funciona? Crypto ID, 2020. Disponível em:

https://cryptoid.com.br/identidade-digital-destaques/visao-computacional-o-que-e-como-funciona/. Acesso

em: 26 de dezembro de 2023.

JOHNSON, Jack. Modbus TCP/RTU (C#): Modbus Programming in C#. 1°. ed. [S. l.]: Amazon, 2016. 50 p.

JANNAH, Erliyan. Detecção robusta de objetos em tempo real. SlideShare, 2013. Disponível em:

https://pt.slideshare.net/erliyahnj/robust-real-time-object-detection . Acesso em: 02 de janeiro de 2024.

LUGER, George F. Inteligência Artificial. 6°. ed. [S. l.]: Pearson, 2015. 632 p.

LAMB, Frank. Automação Industrial na Prática. McGraw-Hill Companies, Inc.. ed. [S. l.]: AMGH, 2015. 376 p. v. 1.

ID, Equipe Crypto. Visão computacional: O que é? Como funciona? Crypto ID, 2020. Disponível em:

https://cryptoid.com.br/identidade-digital-destaques/visao-computacional-o-que-e-como-funciona/. Acesso

em: 26 de dezembro de 2023.](https://image.slidesharecdn.com/visocomputacional2024-cimatec-240531034933-5ecd916d/85/Visao-Computacional-2024-SENAI-CIMATEC-51-320.jpg)