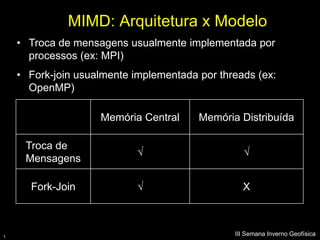

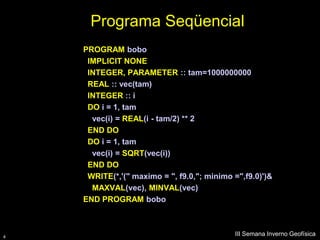

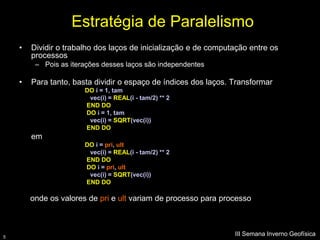

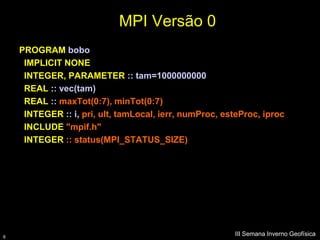

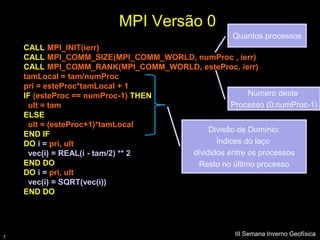

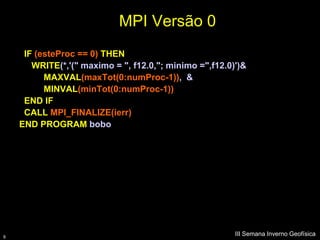

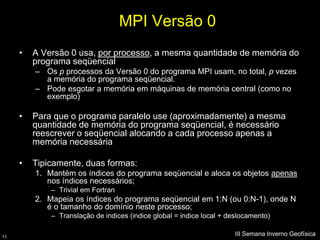

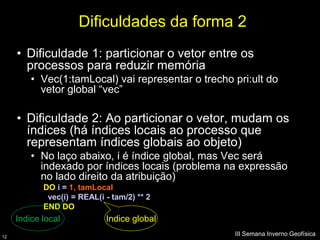

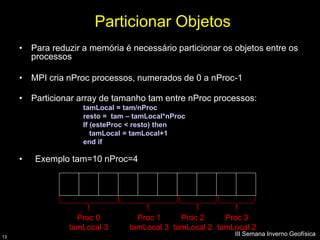

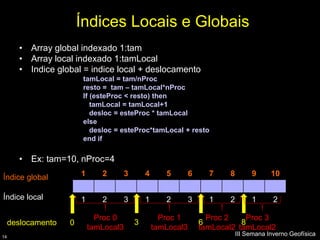

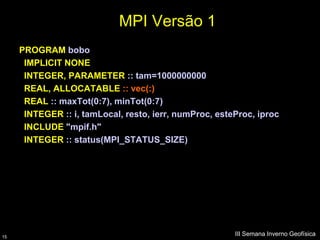

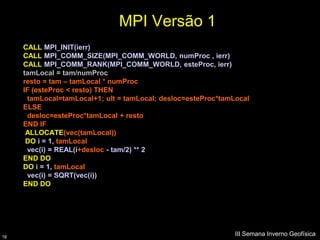

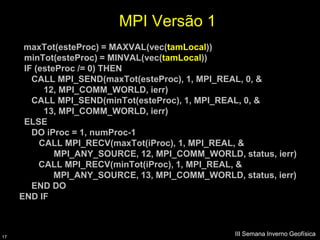

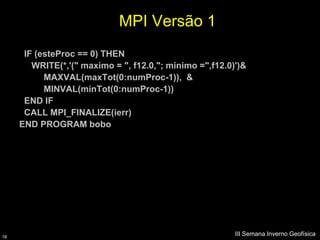

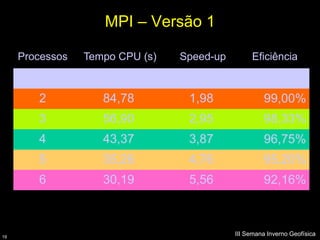

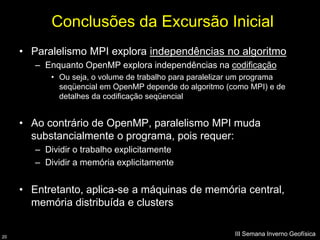

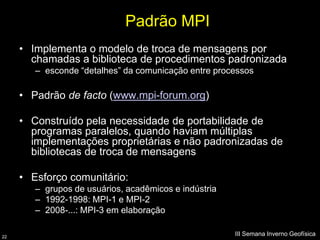

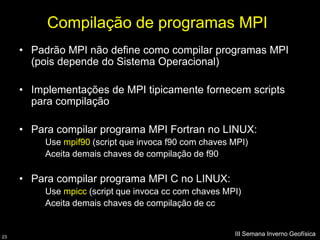

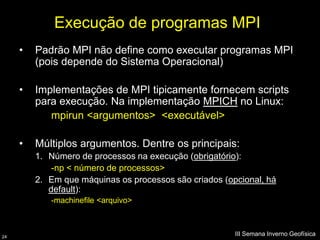

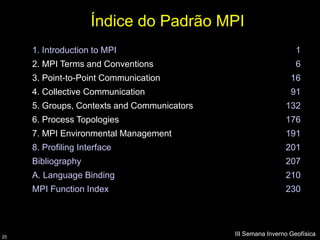

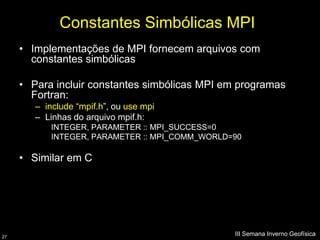

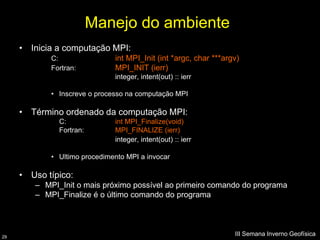

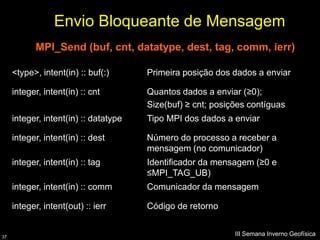

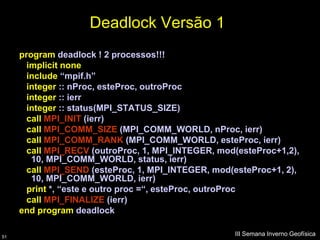

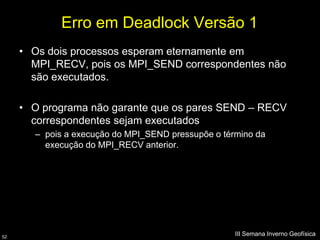

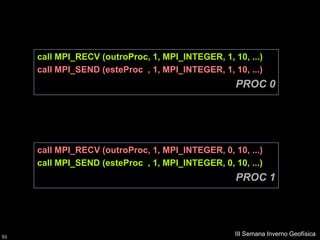

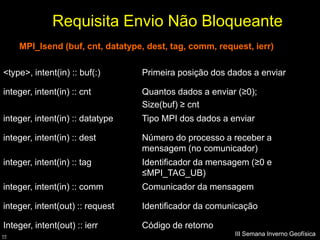

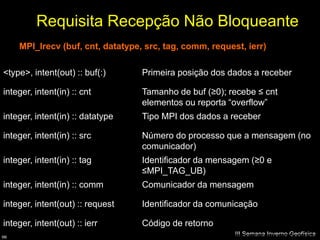

O documento discute a paralelização de programas utilizando a interface de passagem de mensagens MPI, abordando a estrutura de paralelismo e a alocação de memória em ambientes distribuídos. Explora como a divisão de trabalho entre processos pode aumentar a eficiência da computação, além de descrever as dificuldades e as estratégias para a implementação adequada. Também são abordados detalhes da compilação e execução de programas MPI, incluindo exemplos de código em Fortran.