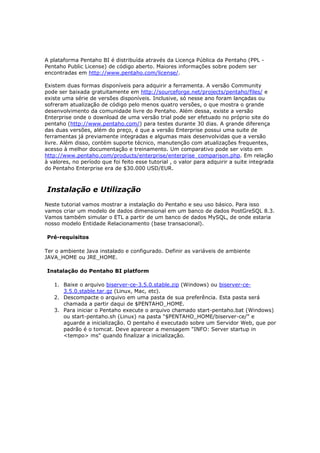

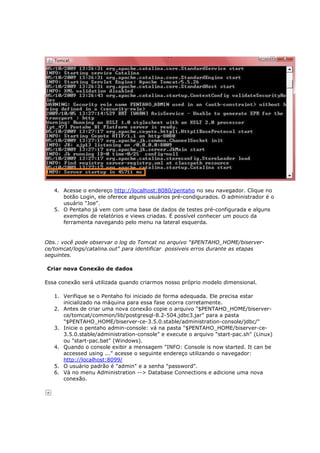

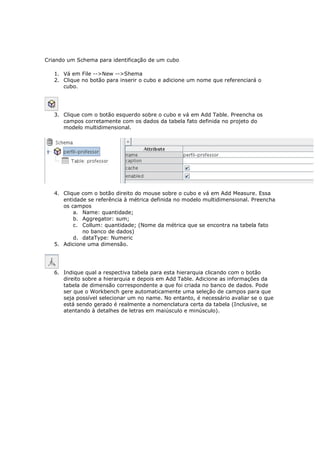

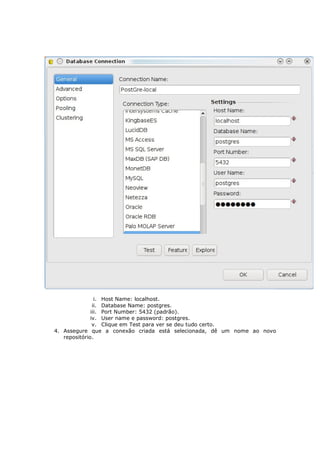

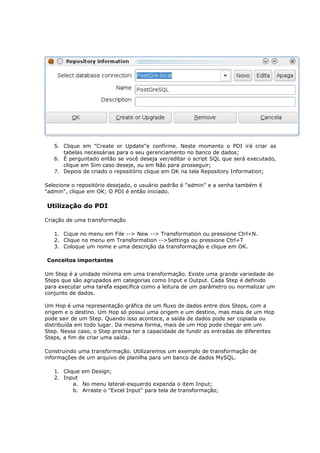

Este documento fornece um tutorial sobre a instalação e utilização da plataforma Pentaho Open BI. O tutorial detalha a instalação do Pentaho 3.5, a criação de um modelo dimensional no banco de dados PostGreSQL, a geração de um schema XML para identificação dos cubos e dimensões, e o processo de ETL para carregar dados no modelo dimensional.