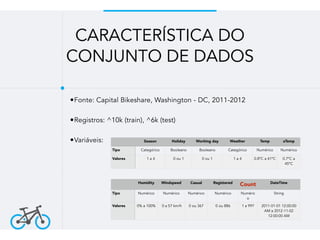

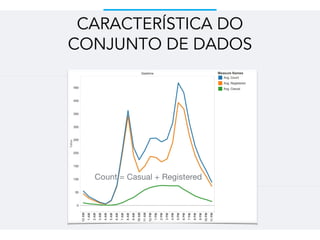

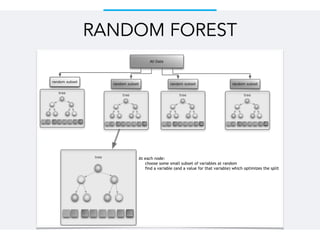

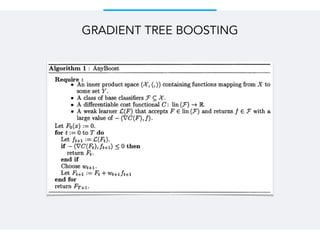

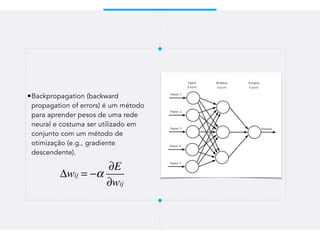

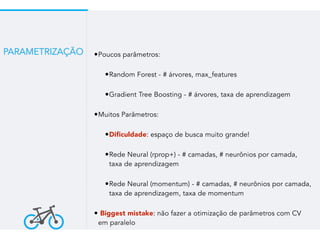

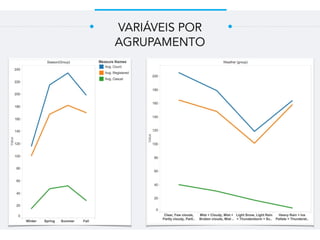

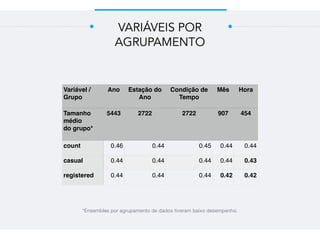

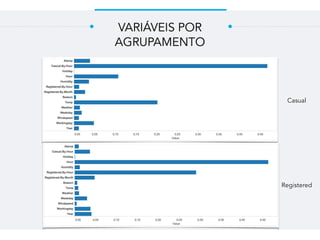

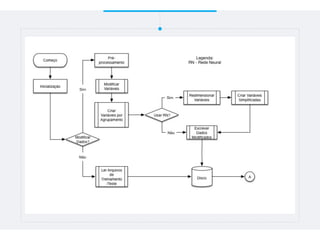

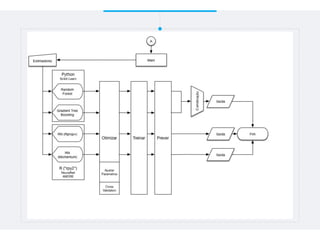

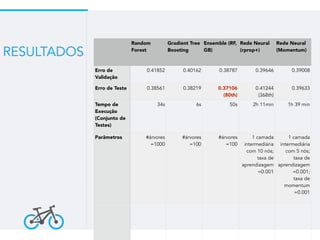

Este documento resume um trabalho de graduação sobre aprendizagem de máquina para previsão de demanda em um sistema de compartilhamento de bicicletas. O objetivo era prever o número total de bicicletas retiradas em um determinado horário usando técnicas como ensembles, random forest, gradient tree boosting e redes neurais. Os resultados mostraram que gradient tree boosting teve o menor erro de validação, enquanto random forest foi mais rápido. Redes neurais tiveram desempenho inferior devido à dificuldade na parametriza