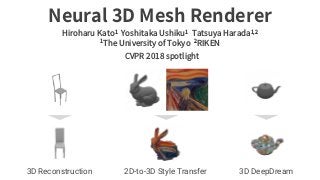

[MIRU 2018 招待講演] Neural 3D Mesh Renderer (CVPR 2018)

MIRU 2018 の招待講演 Neural 3D Mesh Renderer の発表資料です。 - - - - - - - - - - スクリプト 1. ご紹介ありがとうございます。東京大学の加藤です。今年のCVPRで発表したNeural 3D Mesh Rendererという研究を紹介いたします。 2. コンピュータビジョンの多くの問題では2次元画像をもとに3次元空間の情報を推定します。3D再構成が直接的な例ですが、物体認識や画像修復などでも間接的に3D情報の推定が必要です。 3. たとえば姿勢推定を考えます。単純なやり方では、人の3Dモデルをいろいろと変形してみて、それを2次元画像に投影することで正しい姿勢を探します。このとき、姿勢の最適化のためには、変形をどう変えると投影される画像はどう変わるかがわかる、つまり3D空間のパラメータで2Dの画像を微分できると便利です。 4. これと同じパイプラインで、2D画像のスタイルを3Dモデルに転移することができます。レンダリングされた画像のスタイルが、指定された画像と近くなるような、3Dモデルの変形と着色の仕方を見つければよいわけです。ここでも、3D空間のパラメータでレンダリングされた画像を微分できれば簡単に最適化を行えます。 5. さらに、同様のパイプラインで、2D画像を3Dモデルに変換する関数を学習することができます。ここでは、推定された3Dモデルをいろいろな視点からレンダリングし、そのシルエットを正しいシルエットと見比べることで、3D再構成関数を最適化してゆきます。すると、どの視点からも正しく見えるような3Dモデルが再構成されるようになります。 6. つまり、3D空間のパラメータでレンダリングされた画像を微分することができれば、2D画像上で定義された評価値をもとに3D空間のパラメータを最適化でき、これはいろいろなタスクに役に立つといえます。さて、このパイプライン全体をニューラルネットワークで構成することを考えると、レンダリングに対しても逆伝播を定義する必要があります。 7. 3Dモデルの表現形式として、ボクセル、ポイントクラウド、メッシュがよく用いられます。ここでは、テクスチャ付きの高解像度のモデルを扱うため、メッシュを採用します。 8. 以上の動機から、本研究では、誤差逆伝播が定義された3Dメッシュのレンダラーを新しく開発しました。 9. レンダリングの逆伝播や微分を扱う研究は既にいくつかあります。しかし、本研究を除けば、ボクセルを扱うものか、粗く不正確な逆伝播を行うものしかありません。 10. メッシュのレンダリングの入力はポリゴンの頂点座標とテクスチャで、出力は画像です。ここで行う操作のうち、頂点座標やテクスチャの変換は行列とベクトルの四則演算で実現できるため微分可能です。ところが、右上の図のようなラスタライズという処理、2Dのピクセルをサンプリングによって生成する処理だけは微分ができず、そのため誤差逆伝播が定義されません。そこで、ラスタライズの逆伝播を新しく提案します。 11. 1枚のポリゴンと1つのピクセルを例に、ラスタライズの逆伝播を導入します。グレーの三角形が1枚あり、そこからピクセルを生成するとします。ピクセル p の色は白ですが、もし頂点 x が右に動いて、三角形がピクセルにぶつかると、その色は白からグレーに変わります。ピクセルの色の変化はグラフ (a) のようになりますが、この微分はほとんどのところでゼロで、そのため誤差が逆伝播されません。 12. そこで、逆伝播のときにだけ、グラフ (a) ではなくグラフ (b) のような関数になっていると仮定し、偏微分を ⊿p / ⊿x と定義します。しかし、これだけでは不十分です。 13. 誤差逆伝播するときには、目的関数を小さくするためにピクセル p が明るくなるべきか暗くなるべきかがわかっています。一方で、左の図では、グレーの三角形がどう動いても白色のピクセルはこれ以上明るくなれません。つまり、ピクセルが明るくなるべきとき、このポリゴンには誤差逆伝播しない方が良いということです。そこで、このとき微分をゼロとします。このように目的関数から逆伝播された値に応じて逆伝播の振る舞いを変化させます。 14. 提案したレンダラー用いて、画像を3Dモデルに変換する関数を学習しました。入力画像と、同じ物体のシルエット画像、その視点情報をもとに学習を行います。ShapeNetデータセットの13クラスの物体で学習と検証を行いました。 15. こちらが実験結果です。先行手法のボクセルの再構成と比べると、メッシュの再構成は表面がなめらかで、解像度も高いです。また、定量的にも、13クラス中10クラスでボクセルよりも高い再構成性能を示しています。 16. また、提案したレンダラーを用いて、2D画像のスタイルを3Dモデルに転移する実験も行いました。2D画像同士でスタイルを転移する、たとえば左下の図のように写真をムンク風にするというような研究があるのですが、それと同じ評価関数を用いて、3Dモデルの頂点とテクスチャを最適化してゆきます。 17. こちらが実験結果です。たとえばティーポットのふたですが、もともと丸かったものが、スタイル画像のように直線的な形へと変わっています。また、ウサギもバベルの塔にようになっています。このように、画像のスタイルが3Dモデルにきちんと転移できることがわかります。 18. 以上、本研究では、深層学習のためにメッシュのレンダラーを提案し、3D再構成やスタイル転移などに応用しました。疑問点などについてはポスターセッションにお越しください。お聞きいただきありがとうございました。

Recomendados

Mais conteúdo relacionado

Último

Último (12)

Destaque

Destaque (20)

[MIRU 2018 招待講演] Neural 3D Mesh Renderer (CVPR 2018)

- 1. 3D Reconstruction 2D-to-3D Style Transfer 3D DeepDream

- 5. !!

- 10. • •

- 14. !! • •

- 16. • •

- 17. Juan Gris, “Portrait of Pablo Picasso” Pieter Bruegel the Elder, “The Tower of Babel”

- 18. • • 3D Reconstruction 2D-to-3D Style Transfer 3D DeepDream