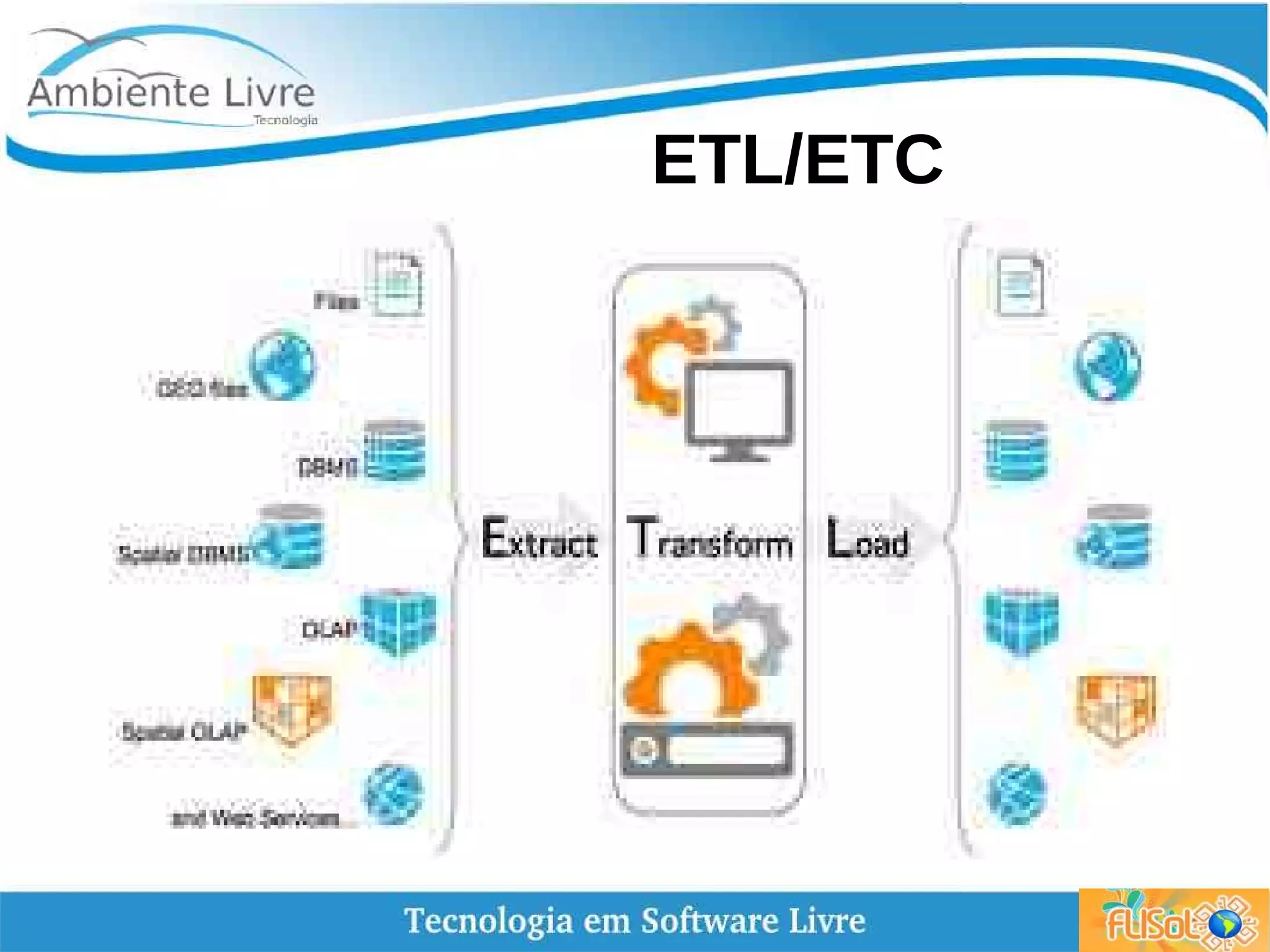

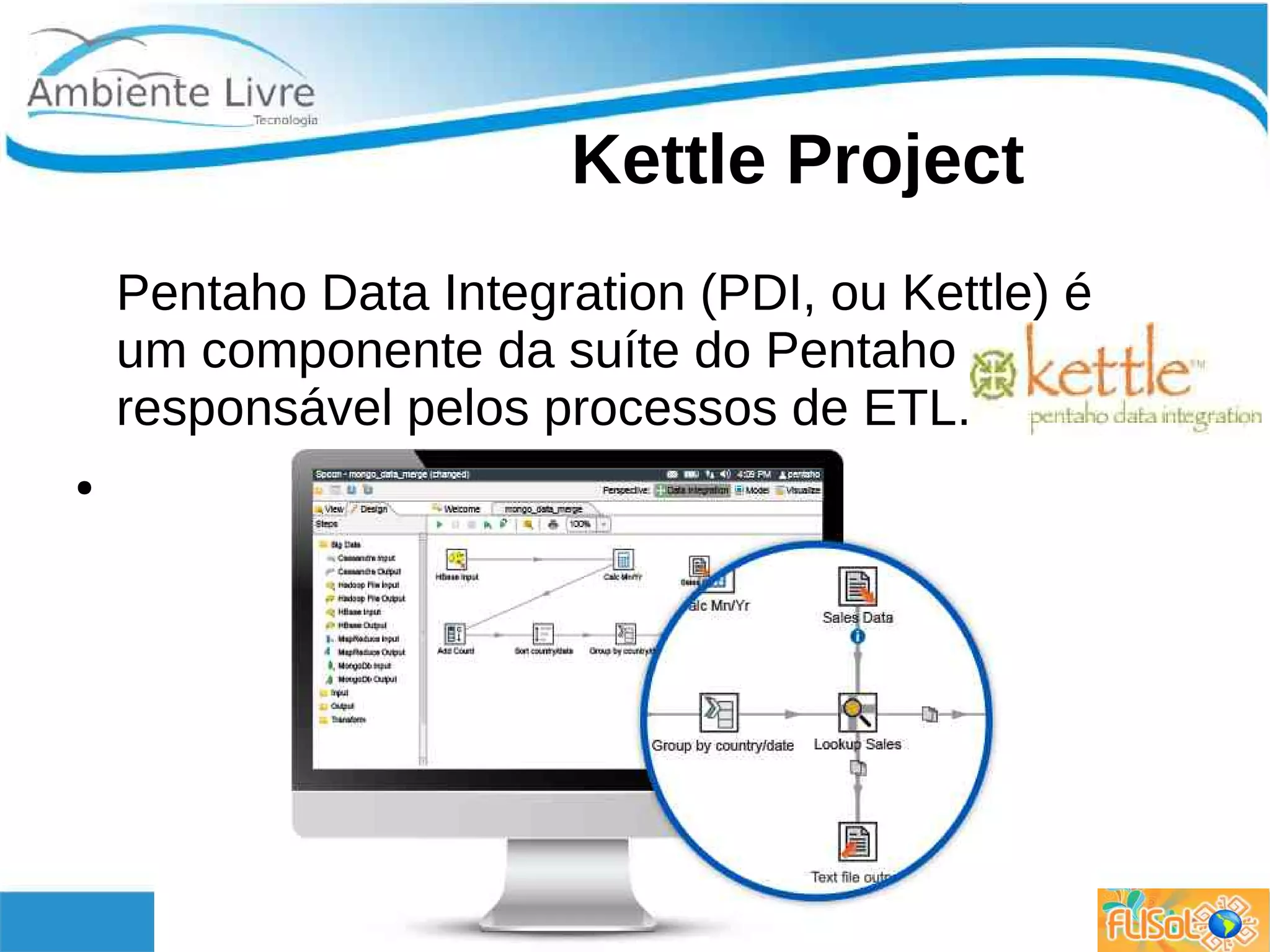

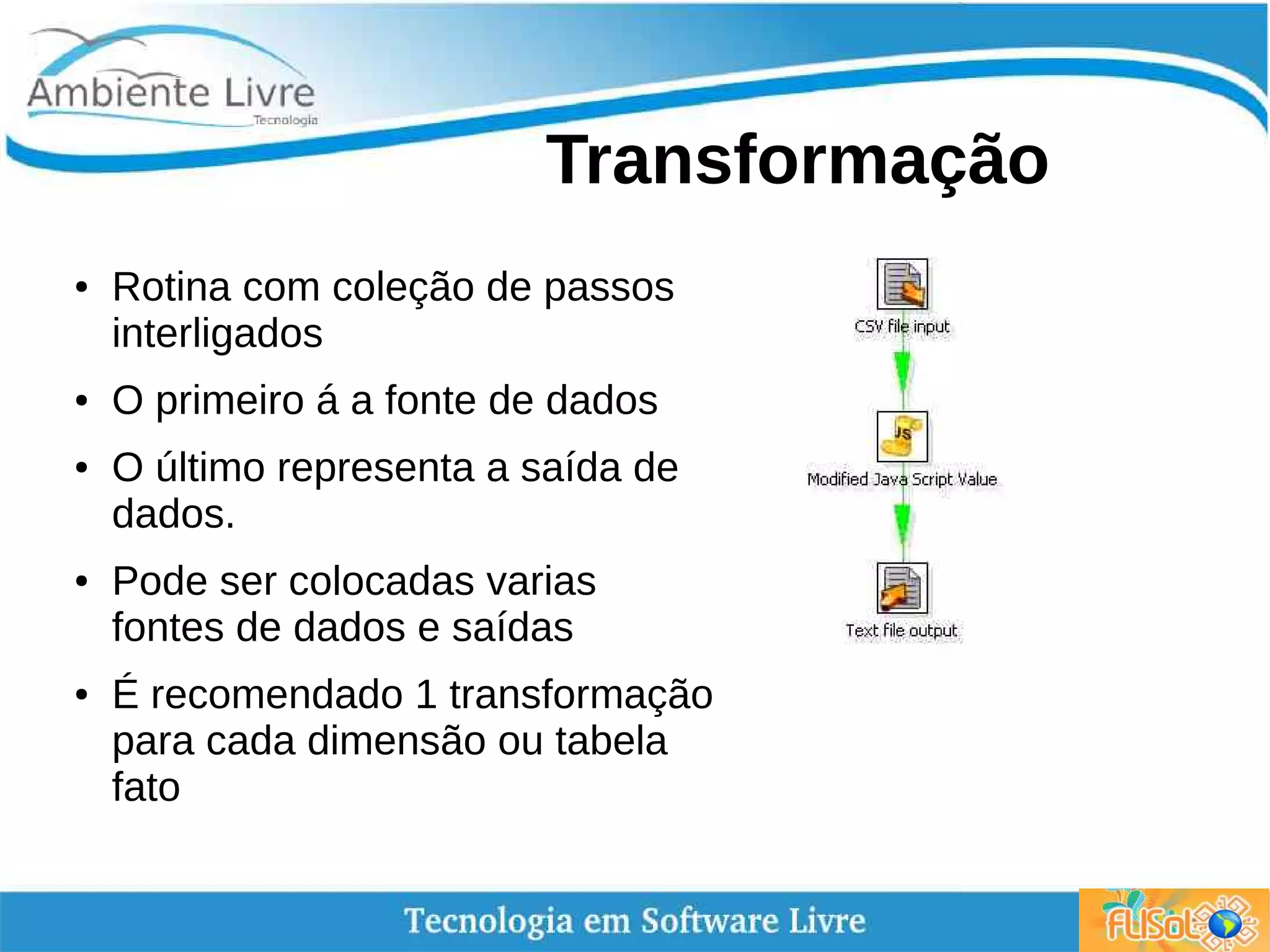

Este documento discute o Pentaho Data Integration (PDI), uma ferramenta open source para integração e migração de dados (ETL). O PDI pode ser usado para migração de dados entre sistemas, exportação de dados para arquivos de texto e carregamento massivo em bancos de dados. Ele possui recursos como processamento paralelo, escalabilidade e diversidade de conectores que o tornam mais adequado do que desenvolver ETL manualmente.