C:\Documents And Settings\Maq 20\Escritorio\Blindlight Dgayo Defensa 60

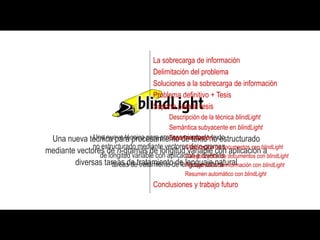

- 1. La sobrecarga de información Delimitación del problema Soluciones a la sobrecarga de información Problema definitivo + Tesis Soporte para la tesis Descripción de la técnica blindLight Semántica subyacente en blindLight Una nueva técnica para procesamiento de texto Experimentación Una nueva técnica para procesamiento de texto no estructurado no estructurado mediante vectores de n-gramas mediante vectores de n-gramas de longitudClasificación con aplicaciónblindLight variable de documentos con a de longitud variable con aplicación a diversas documentos con blindLight Categorización de diversas tareas de tratamientode lenguaje natural información con blindLight tareas de tratamiento de Recuperación de lenguaje natural Resumen automático con blindLight Conclusiones y trabajo futuro

- 2. La sobrecarga de información sufrimos Gracias a la Web accedemos a una gran cantidad de información. %

- 3. La sobrecarga de información “documentary data are being generated at En la actualidad es aún peor… an alarming rate” USENET: 845 millones de mensajes desde 1981 (100.000 (Maron y Kuhns 1960) mensajes nuevos al día). Web superficial (“estática”) ¿4.000 millones de páginas? Web oculta (accesible mediante formularios) ¿2x, 5x, 500x? Reuters: 11.000 artículos diarios (2,5 millones de palabras). LNCS: 356 volúmenes en 2003 (90 millones de palabras). “The tradeoff between ease of publishing Más de 370 millones de usuarios de Internet… (writing) and ease of querying (reading) on Sólo en EE.UU: the web has tilted dangerously in favor of 95 millones de usuarios adultos. 13% webmasters (12,4 millones). the former.” 2% bloggers (1,9 millones). (Manber 1996) ¿5 millones de bloggers en el mundo? 3%

- 4. Delimitación del problema La Web como sistema En la concepción original de la Web (Berners-Lee 1989) se alerta sobre los de recuperación de inconvenientes de la búsqueda mediante palabras clave información De hecho, probabilidad de coincidencia en el uso de un mismo término por dos individuos es sólo del 10-20% (Furnas et al. 1987) Aún así la Web nació sin sistema de búsqueda. Al principio (1990-1993) era sencillo mantener manualmente directorios de sitios web. Posteriormente se combinan “arañas” para explorar e indexar la Web y sistemas de búsqueda ¡basados en consultas mediante palabras clave! 5%

- 5. Delimitación del problema Motores de Buscadores aceptan consultas construidas mediante palabras clave pero… búsqueda en la Web … la relevancia de un documento no se basa en su contenido y en el de la consulta y su problemática sino que cada documento posee un valor indicador de su “prestigio” en base a: El número de enlaces (citas) que recibe. El prestigio de los documentos que lo enlazan (citan). Google (Brin y Page 1998) emplea el algoritmo PageRank (Page et al. 1998), similar al método propuesto por Kleinberg (1998). A mayor “prestigio” mayor relevancia en la lista de resultados. Los sistemas de “prestigio” fallan (Bharat y Henzinger 1998) y las debilidades pueden explotarse fácilmente (p.ej. granjas de enlaces y bombas Google). ¿Eppur si muove? 6%

- 6. Delimitación del problema A pesar de todo, ¿es o no conveniente la Además, según Jansen y Spink (2003): búsqueda en la Web mediante palabras clave? 66% de los usuarios examinan 5 resultados o menos. Según Jansen et al. (1998) y Silverstein et al. 30% de los usuarios examinan un único resultado. (1998) los buscadores en la Web son adecuados Jansen y Spink concluyen: para la mayor parte de usuarios: Las necesidades de información de la mayor parte de 67-78% de los usuarios resuelven una necesidad usuarios no son complejas. de información con menos de 2 consultas. Los primeros resultados son verdaderas autoridades. 58-85% de los usuarios analizan sólo la primera 50% de los resultados son relevantes página de resultados. (en promedio). 8%

- 7. Delimitación del problema Ciertamente, las necesidades de información más shrek 2 (1ª España) páginas amarillas (2ª España) frecuentes para la mayoría de los usuarios no son chistes (9ª España) complejas… olympics (1ª mundo) paris hilton (7ª mundo) Algunas de las consultas más frecuentes realizadas por usuarios nudist+image (19ª mundo) españoles y de todo el mundo en julio y agosto de 2004. weather (20ª mundo) Sin embargo, la mayoría de las consultas son poco cape plumbago photo captree school + west islip frecuentes (Silverstein et al. 1998): handwoven yoga mats 86,4% se repiten como máximo 3 veces. "salas surgical group california" 63,7% aparecen una única vez. pcgs + indian cent cameo ymca swimming lessons- kalamazoo, mi Algunas consultas capturadas en tiempo real el 17 de agosto de 2004. "motorcycle tent trailer" 9%

- 8. Delimitación del problema Tipos de consultas (Broder 2002) 10% de las consultas son de carácter sexual , el resto se clasifican en: El usuario trata de llegar a un sitio shrek 2 Navegacionales (20-24,5%) web conocido. el corte ingles El usuario desea encontrar cape plumbago photo Informativas (39-48%) información que supone se encuentra degenerative disc disease en una o más páginas web. El usuario desea realizar algún tipo paginas amarillas Transaccionales (36-30%) de actividad vía web. weather 11%

- 9. Delimitación del problema En promedio el 50 % de los ¿Es cierto también en el caso de las consultas informativas? resultados son relevantes En efecto, las consultas informativas obtienen en promedio alrededor de un 50% de resultados revelantes. (Jansen y Spink 2003)… ¿Cuál es la dispersión? Sin embargo, se estima que el 15-20% de las consultas que se envían a un buscador no obtienen ningún resultado relevante entre los 10 primeros (aunque reciben miles). (Gayo Avello 2005, pp.13-18) 13%

- 10. Delimitación del problema …Además, se producen La ausencia de “prestigio” no implica carencia de relevancia. “daños colaterales” Al desvincularse el “prestigio” de los contenidos, los resultados “relevantes” pueden satisfacer la consulta pero no al usuario. El autor del documento puede no desear tales visitas. 14%

- 11. Delimitación del problema El problema es… “La sobrecarga de información que experimentan los usuarios al tratar de resolver en la Web consultas informativas formuladas en lenguajes naturales de manera tal vez ambigua y, en ocasiones, con errores tipográficos, ortográficos o gramaticales.” 16%

- 12. Soluciones a la sobrecarga de información Analizadas no sólo en la Web sino también en USENET y correo electrónico. Generalmente basadas en una o más de las siguientes tres técnicas: - Agentes - Filtrado colaborativo (Goldberg et al. 1992) - Recomendación por contenidos Algunas conclusiones “Los usuarios proporcionan feedback explícito sólo a regañadientes” (Balabanovic 1998, p.6). La evaluación implícita proporciona información igualmente útil (Morita y Shinoda 1994) (Lieberman 1995) (Konstan et al. 1997) La coincidencia de palabras clave es inadecuada (Balabanovic et al. 1995, p.8) y otros mecanismos ofrecen mejores resultados (Morita y Shinoda 1994). Los datos acerca de los intereses de los distintos usuarios son muy valiosos al combinarse entre sí (Rucker y Marcos 1997) (Kantor et al. 2000). 17%

- 13. Soluciones a la sobrecarga de información Web Semántica “La Web Semántica es una extensión de la Web actual en la cual se asigna a la información un significado bien definido, posibilitando una mejor cooperación entre máquinas y usuarios” (Berners-Lee et al. 2001). Facilitará el “consumo” de los documentos a agentes software etiquetando los documentos con metadatos organizados mediante ontologías. El consorcio W3C trabaja en la definición de SPARQL (Prud'hommeaux y Seaborne 2005), un lenguaje de consulta para extraer información de grafos RDF. Ejemplos de necesidades de información que podrá satisfacer la Web Semántica: “Encontrar el artículo más reciente sobre SHOE en el que Hendler figure como coautor.” “Recibir información sobre libros, películas y música que cumplan unos criterios de título y autor.” Compárese con el tipo de consultas libres que afrontan los buscadores web: mao zedong / mao tse tung muscel (sic) aches during pregnancy 19%

- 14. Soluciones a la sobrecarga de información ¿Es la Web Semántica “La Web Semántica será muy útil en campos bien definidos (p.ej. comercio una solución al electrónico o bibliotecas digitales) pero hay mucha más información útil fuera de problema descrito? su alcance.” (Gayo Avello y Álvarez Gutiérrez 2002). La Web Semántica necesita un complemento… “Muchos han defendido la Web Semántica como un medio para mejorar la recuperación de información en la Web [argumentando que] no resulta adecuada para el procesamiento automático puesto que la información no está estructurada. […] Resulta sencillo prever el etiquetado implícito de catálogos de productos pero podría ser desalentador anotar semánticamente largos pasajes de texto […] Un escenario complementario prevé algoritmos suficientemente inteligentes como para inferir semántica de la Web actual, no estructurada pero auto-organizada, sin ayuda de etiquetas semánticas.” (Flake et al. 2003) 20%

- 15. Soluciones a la sobrecarga de información Complementando ¿Folksonomías? la Web Semántica Del inglés folksonomy = folk + taxonomy. Etiquetado colaborativo de documentos. Fenómeno incipiente pero muy alentador (p.ej. del.icio.us) Web Cooperativa “La Web Cooperativa es una capa situada directamente sobre la Web actual con el fin de dotarla de semántica de manera global, automática, transparente e independiente del idioma. Requiere la participación de los usuarios pero no de forma consciente y directa sino indirectamente a través de agentes autónomos y cooperantes. La Web Cooperativa se apoya sobre el uso de conceptos y taxonomías documentales, unos y otras pueden obtenerse, sin intervención humana, a partir del texto libre de los documentos.” (Gayo Avello 2002) 22%

- 16. Formulación definitiva del problema El problema… “La cantidad de texto no estructurado en la Web seguirá aumentando y el método preferido por los usuarios para recuperar información continuarán siendo las consultas formuladas en lenguajes naturales. Tanto en la publicación como en la consulta será inevitable un uso ambiguo de los distintos idiomas y la presencia de errores tipográficos, ortográficos o gramaticales.” 23%

- 17. Tesis (versión resumida) “Una única técnica sencilla, basada en el uso de vectores de n-gramas de longitud variable, independiente del idioma y aplicable a diversas tareas de tratamiento de lenguaje natural con resultados similares a los de otros métodos „ad hoc‟ es viable.” 25%

- 18. Tesis Se puede obtener para los distintos n-gramas, gi, de un texto escrito en cualquier idioma una medida de su significatividad, si, distinta de la frecuencia relativa de aparición de los mismos en el texto, fi, pero calculable a partir de la misma. Esta métrica de la significatividad intradocumental de los n-gramas permite asociar a cada documento, di, un único vector, vi, susceptible de comparación con cualquier otro vector obtenido del mismo modo aun cuando sus respectivas longitudes puedan diferir. Puesto que tales vectores almacenan ciertos aspectos de la semántica subyacente a los textos originales, el mayor o menor grado de similitud entre los mismos constituye un indicador de su nivel de relación conceptual, facilitando la clasificación y categorización de documentos, así como la recuperación de información. Asimismo, cada vector individual es capaz de transformar el texto original a partir del cual fue obtenido dando lugar a secuencias de palabras clave y resúmenes automáticos. 27%

- 19. Soporte para la tesis ¿Significatividad de n-gramas? Descripción de la técnica blindLight ¿Comparación de vectores de n-gramas? ¿Conservan dichos vectores aspectos semánticos? Clasificación de (mini)corpora paralelos ¿Clasificación y categorización de documentos? ¿Recuperación de información? Experimentación ¿Resumen automático? 28%

- 20. Descripción de la técnica blindLight blindLight, una técnica ¿Es posible obtener un “pseudo-ADN” a partir de texto escrito en un lenguaje bio-inspirada natural? El ADN de un documento es un conjunto de genes donde cada gen está formado por un n-grama de caracteres y su correspondiente significatividad dentro del documento de origen. No se emplean técnicas de alineación de secuencias para las comparaciones de “genomas” sino que éstos pueden combinarse constituyendo “híbridos” que serán comparados con los originales a fin de determinar la similitud entre los mismos. El “genoma” de un documento puede “actuar” sobre el texto del documento, a modo de “ARN transferente”, transformándolo en resúmenes y frases clave. 30%

- 21. Descripción de la técnica blindLight Fundamentos teóricos Un n-grama es una secuencia de n elementos extraídos de un texto de forma de blindLight no necesariamente correlativa. blindLight utiliza n-gramas formados por n caracteres contiguos que pueden incluir blancos. Se puede obtener para los distintos n-gramas, gi, de Des, esc, scr, cri, rip, ipc, pci, ció, ión, ón_, n_d, _de, de_, e_l, … un texto escrito en cualquier Cada n-grama tiene asociado un peso que indica cuan o cuan poco idioma una medida de su significativa resulta su aparición en el documento. significatividad, si, distinta de la frecuencia relativa de Dunning (1993) empleó el likelihood ratio test para detectar terminología y aparición de los mismos en palabras clave. Aplicable únicamente a bigramas (de palabras). el texto, fi, pero calculable a likelihood ratio, ratio test, likelihood ratio test partir de la misma. 31%

- 22. Descripción de la técnica blindLight Fundamentos teóricos Ferreira da Silva y Pereira Lopes (1999) desarrollaron un método para de blindLight generalizar diversos estadísticos para la detección de frases clave de longitud arbitraria. Probabilidad condicional simétrica, información mútua, 2, log likelihood, Dice blindLight aplica dichos estadísticos a n-gramas de caracteres para el cálculo de su significatividad y construir así los “genes” del documento. Se puede obtener para los distintos n-gramas, gi, de 1 n 1 (w1..wn) es un n-grama, p. ej. (igni) Avp p( w1..wi ) p( wi 1..wn ) un texto escrito en cualquier n 1i 1 (w1..w1) (w2..w4) (i)(gni) idioma una medida de su p( wi ..wn ) 2 (w1..w2) (w3..w4) (ig)(ni) significatividad, si, distinta de SCP _ f ((wi ..wn )) la frecuencia relativa de Avp (w1..w3) (w4..w4) (ign)(i) aparición de los mismos en p( wi ..wn ) SI _ f ((wi ..wn )) log p(w1..w1) igni, ific, ivid el texto, fi, pero calculable a Avp partir de la misma. p(w4..w4) igni, nifi, cati, tivi 33%

- 23. Descripción de la técnica blindLight Fundamentos teóricos Los “genomas” documentales pueden combinarse constituyendo “híbridos” que de blindLight serán comparados con los originales para determinar la similitud entre los mismos. Q y T dos vectores blindLight de dimensiones m y n Esta métrica de la Q k1Q , w1Q k 2Q , w2Q k mQ , wmQ significatividad T k1T , w1T k 2T , w2T k nT , wnT intradocumental de los kij es el n-grama i-ésimo del documento j y wij es la significatividad de dicho n-gramas permite asociar a n-grama empleando alguno de los estadísticos anteriores. cada documento, di, un único vector, vi, susceptible de La significatividad total para dichos vectores será entonces… comparación con cualquier m otro vector obtenido del SQ wiQ i 1 mismo modo aun cuando sus n respectivas longitudes ST wiT puedan diferir. (Gayo Avello 2005, pp.63-65) i 1 34%

- 24. Descripción de la técnica blindLight Fundamentos teóricos Los “genomas” documentales pueden combinarse constituyendo “híbridos” que de blindLight serán comparados con los originales para determinar la similitud entre los mismos. El operador de intersección (“hibridación”) Esta métrica de la kx kiQ k jT wx min(wiQ , w jT ) , significatividad Q T k x , wx (kiQ , wiQ ) Q,0 i m, intradocumental de los n-gramas permite asociar a (k jT , w jT ) T ,0 j n cada documento, di, un único La significatividad total del vector intersección será… SQ T wiQ T vector, vi, susceptible de Se definen dos medidas asimétricas comparación con cualquier (Pi mayúscula) para comparar Q con T SQ / SQ otro vector obtenido del T mismo modo aun cuando sus (Rho mayúscula) para comparar T con Q SQ / ST T respectivas longitudes puedan diferir. (Gayo Avello 2005, pp.63-65) 36%

- 25. Descripción de la técnica blindLight Fundamentos teóricos Los “genomas” documentales pueden combinarse constituyendo “híbridos” que de blindLight serán comparados con los originales para determinar la similitud entre los mismos. Esta métrica de la ki wi ki wi ki wi Cuan 2.49 va_l 2.55 saur 2.24 significatividad l_di 2.39 rdou 2.32 inos 2.18 intradocumental de los stab 2.39 stav 2.32 uand 2.12 n-gramas permite asociar a … … _est 2.09 saur 2.31 saur 2.24 dino 2.02 cada documento, di, un único desp 2.31 noss 2.18 = _din 2.02 vector, vi, susceptible de … … esta 2.01 comparación con cualquier ando 2.01 auro 1.91 ndo_ 1.98 otro vector obtenido del avía 1.95 ando 1.88 a_es 1.94 _all 1.92 do_a 1.77 ando 1.88 mismo modo aun cuando sus =20.48/97.52 respectivas longitudes SQ=97.52 ST=81.92 SQ T=20.48 =20.48/81.92 puedan diferir. (Gayo Avello 2005, pp.63-65) 38%

- 26. Descripción de la técnica blindLight Fundamentos teóricos Los “genomas” documentales pueden combinarse constituyendo “híbridos” que de blindLight serán comparados con los originales para determinar la similitud entre los mismos. Combinando y pueden construirse distintas medidas de similitud. Esta métrica de la significatividad Posibilidad de utilizar programación genética para obtener nuevas medidas intradocumental de los (Fan et al. 2004a y 2004b). n-gramas permite asociar a Otras medidas de similitud entre ítems de información cada documento, di, un único Algoritmos de compresión (Varré et al. 1999) (Chen et al. 1999) (Li et al. 2004) vector, vi, susceptible de comparación con cualquier Earth Mover‟s Distance (Rubner et al. 2000) otro vector obtenido del Sequence Nearest Neighbors (Muthukrishnan y Sahinalp 2000) mismo modo aun cuando sus respectivas longitudes (Gayo Avello 2005, pp.63-65) puedan diferir. 39%

- 27. Descripción de la técnica blindLight En conclusión… “Se puede obtener para los distintos n-gramas, gi, de un texto escrito en cualquier idioma una medida de su significatividad, si, distinta de la frecuencia relativa de aparición de los mismos en el texto, fi, pero calculable a partir de la misma. Esta métrica de la significatividad intradocumental de los n-gramas permite asociar a cada documento, di, un único vector, vi, susceptible de comparación con cualquier otro vector obtenido del mismo modo aun cuando sus respectivas longitudes puedan diferir.” 41%

- 28. Descripción de la técnica blindLight Relación de Similar al modelo vectorial… No obstante, no emplea operaciones vectoriales para blindLight con determinar la similitud sino que “hibrida” los distintos vectores y, posteriormente, otras técnicas compara el vector resultante con los originales. Similitudes superficiales con otras técnicas PLN estadísticas basadas en n-gramas de caracteres Acquaintance (Damashek 1995) Usa frecuencias relativas como pesos, no aplicable a la extracción de resúmenes. Highlights (Cohen 1995) Extracción de palabras clave (no resúmenes), utiliza un contexto de documentos. Otros autores hablan de “genómas documentales” (Abir et al. 2002) pero, aparentemente, sólo blindLight propone “hibridar” tales genomas o aplicarlos sobre el texto a modo de ARNt. En el caso de blindLight no se trata de una mera metáfora. 42%

- 29. Semántica subyacente en blindLight “Puesto que tales vectores almacenan ciertos aspectos de la semántica subyacente a los textos originales, el mayor o menor grado de similitud entre los mismos constituye un indicador de su nivel de relación conceptual” 44%

- 30. Semántica subyacente en blindLight ¿Qué semántica? Semántica en el sentido de Dumais et al. (1988): “Damos por supuesto que bajo los datos de uso de palabras existe algún tipo de estructura semántica „latente‟ parcialmente oculta por la variabilidad en la elección de esas palabras.” Clasificación de Si blindLight conserva la semántica de los documentos entonces clasificaciones de (mini)corpora corpora paralelos deberían ser similares con independencia del idioma empleado en paralelos cada corpus y plausibles según criterios humanos. Corpus Génesis 1:1-3:24 Condiciones de uso de MSN (abril 2003) Licencia Creative Commons Convención de Viena sobre Compraventa de Mercancías Licencia GNU-GPL Declaración Universal de los Derechos Humanos Condiciones de uso de Google (septiembre 2004) 45%

- 31. Semántica subyacente en blindLight Genesis-EN Clasificación de (mini)corpora UN-HumanRights-EN paralelos UN-ConventionSaleGoods-EN CreativeCommons-EN MSNTermsOfService-EN GNU-GPL-EN GoogleTermsOfService-EN 47%

- 32. Semántica subyacente en blindLight Clasificación de Resultados muy similares en todos los corpora (mini)corpora Divergencias en francés, hebreo y japonés paralelos Traducciones no totalmente literales ¿Problemas trasliteración? A pesar de las divergencias existentes en el caso de francés, hebreo y japonés parece claro que blindLight obtiene clasificaciones muy similares para corpora paralelos con independencia del idioma y la longitud de los documentos. Dichas clasificaciones, además, son plausibles según criterios humanos puesto que tienden a agrupar documentos de contenido semejante y mantener separados textos de temática muy distinta en todos los idiomas. 48%

- 33. Semántica subyacente en blindLight En conclusión… “Al aplicar blindLight sobre texto natural se obtienen vectores que conservan ciertos aspectos de la semántica latente en los textos originales permitiendo una comparación a un nivel conceptual.” 50%

- 34. Clasificación de documentos con blindLight El problema de la Agrupamiento, clasificación no supervisada o clustering clasificación Identificación, dentro de un conjunto de elementos, de grupos con características similares. Puede llevarse a cabo dividiendo de manera iterativa el conjunto original en subconjuntos o comenzar por los elementos aislados e ir agrupando los más próximos (similares). Existe también la posibilidad de operar sobre todo el conjunto simultaneamente o de manera paulativa. Una técnica de clasificación requiere… Un modo de representar los documentos, habitualmente “un vector multidimensional donde cada dimensión corresponde a una única característica” (Duda y Hart 1973) Una medida de similitud entre dichas representaciones. Un algoritmo para construir los grupos en base a la medida anterior. 52%

- 35. Clasificación de documentos con blindLight Aplicación de Documentos representados como vectores de n-gramas y pesos. blindLight a la Medida de similitud PiRo (Gayo Avello 2005, p.66, ecuación 12). clasificación de Dos algoritmos de agrupamiento: documentos No incremental. Similar al método shared nearest neighbor clustering (Jarvis y Patrick 1973). Emplea el coeficiente de Bray y Curtis (1957) para determinar qué documentos exhiben un “comportamiento” similar en la colección (Gayo Avello 2005, pp.85-87). Incremental (Gayo Avello 2005, pp. 87-90). Experimentación Clasificación de lenguajes naturales Colecciones TIME y CIA Colección WebACE Project 53%

- 36. Clasificación de documentos con blindLight Basque Clasificación de lenguajes naturales Romances Datos léxicos, Libro Portuguese Spanish Finnish del Génesis Italian French Indoeuropeos Catalan Germánicos Germánicos del oeste Faroese German Germánicos del norte Swedish Danish 1 Dutch Norwegian English 55%

- 37. Clasificación de documentos con blindLight Clasificación de ðə ˈnɔɹθ ˌwɪnd ən ə ˈsʌn wɚ dɪsˈpjutɪŋ ˈwɪtʃ wəz ðə ˈstɹɑŋgɚ, wɛn ə ˈtɹævlɚ kem əˈlɑŋ ˈɹæpt ɪn ə ˈwɔɹm ˈklok… lenguajes naturales The North Wind and the Sun were disputing which was the stronger, when a traveller came Datos fonéticos, El along wrapped in a warm cloak… Viento del Norte y el English Sol (IPA 1999) Los resultados de G alician Spanish ambos experimentos Portuguese son consistentes entre sí y con la Swedish clasificación French comunmente Catalan aceptada. Dutch 1 G erman 56%

- 38. Clasificación de documentos con blindLight Colecciones TIME y La colección TIME (Salton 1972) consiste en 423 artículos publicados durante CIA (blindLight vs. SOM) 1963 en la sección internacional de dicha revista. Los documentos abarcan diversos temas (Vietnam, la guerra fría o escándalos políticos). La colección CIA se corresponde con la edición de 1990 de The World Fact Book. Consta de 246 documentos y describe en términos geográficos, sociales, económicos y políticos distintas regiones y países del planeta. Ambas colecciones permitieron comparar los resultados obtenidos por blindLight con los alcanzados mediante Self-Organizing Maps (Merkl y Rauber 1998). Los resultados obtenidos por blindLight son análogos a los alcanzados con Self-Organizing Maps. 58%

- 39. Clasificación de documentos con blindLight Colección CIA El primer gráfico muestra el denominado “Norte Rico” que incluye a la URSS, Australia y Nueva Zelanda. El segundo mapa contiene países vinculados a la URSS ideológica, económica, militar y/o geográficamente: el “Telón de Acero”, Irán (fronterizo) o Afganistan (fronterizo y ocupado). El tercer gráfico agrupa la mayor parte de Asia mientras el siguiente divide África en tres grandes grupos, destacando nuevamente la zona de Oriente Próximo. El último mapa coincide con Latinoamérica (nótese la ausencia de la Guyana Francesa) aunque incluye Liberia en un curioso salto transatlántico. 59%

- 40. Clasificación de documentos con blindLight Colección wap La colección wap (Han et al. 1998) consta de 1560 páginas web extraídas de (WebACE Project) Yahoo! y pertenecientes a una categoría única de 20 posibles. Pudo calcularse la similitud promedio y la entropía para la clasificación obtenida por blindLight y compararla con los resultados obtenidos por otras técnicas (Steinbach et al. 2000). k-medias k-medias UPGMA blindLight k-medias bisecante UPGMA bisecante “refinado” “refinado” Entropía 1,1907 1,2230 1,0888 1,0397 1,3486 1,2561 Diferencia -2,64% -11,71% -5,21% 9,36% 14,52% respecto a Inapreciable Sustancial Apreciable Apreciable Sustancial blindLight (A favor de bL) (A favor de bL) (A favor de bL) k-medias k-medias UPGMA blindLight k-medias bisecante UPGMA bisecante “refinado” “refinado” Similitud promedio 0,4270 Diferencia 0,3943 8,29% 0,3914 9,10% 0,3988 7,07% 0,3634 17,50% 0,3728 14,54% respecto a Apreciable Apreciable Apreciable Sustancial Sustancial blindLight 61%

- 41. Clasificación de documentos con blindLight En conclusión… “Al aplicar blindLight al problema de la clasificación automática de documentos puede concluirse que, al menos en lo que se refiere a las colecciones TIME, CIA y wap, es posible obtener unos resultados semejantes, si no mejores, que los de técnicas específicas como mapas auto-organizativos, métodos particionales y métodos jerárquicos.” 63%

- 42. Categorización de documentos con blindLight Categorización La categorización automática permite asignar a un ítem, en función de sus características, como aprendizaje una etiqueta tomada de un conjunto predefinido. La categorización automática resulta muy útil para aliviar la sobrecarga de información: Asignar temas a documentos o topic tagging (Cohen 1996) (Maarek y Ben Shaul 1996) (Chekuri et al. 1997) (Attardi et al. 1999) (Li et al. 1999) Determinar si un documento es o no relevante para un usuario (Schütze et al. 1995) Filtrar correo no deseado o spam (Sahami et al. 1998) Habitualmente se emplean técnicas de aprendizaje automático que se entrenan sobre un conjunto de elementos ya etiquetados. Árboles y reglas de decisión Algoritmo de Rocchio Categorizadores bayesianos Método de boosting Redes neuronales Support Vector Machines Mapas auto-organizativos 64%

- 43. Categorización de documentos con blindLight Categorización Documentos y categorías deben estar disponibles como vectores de n-gramas. con blindLight Un vector categoría puede obtenerse a partir de una única muestra o de varios ejemplos: Calcular vector de n-gramas para cada documento de entrenamiento Calcular el centroide de cada categoría Calcular el centroide de todos los documentos de entrenamiento Restar al centroide de cada categoría el centroide del conjunto de entrenamiento Para categorizar un documento desconocido se compara con los distintos vectores categoría y el de mayor similitud indicará la categoría apropiada. n =0,5 n: número de n-gramas en el vector categoría PiRoNorm · (1 )· · m: número de n-gramas en el documento m desconocido. 66%

- 44. Categorización de documentos con blindLight Experimentación Identificación automática del idioma de un texto El problema de los Federalist Papers Filtrado de correo no deseado (spam) Colecciones estándar (Reuters-21578 y OHSUMED) 67%

- 45. Categorización de documentos con blindLight Identificación Se llevaron a cabo dos experimentos (textos muy cortos y con ruido) y se comparó blindLight automática con tres sistemas: TEXTCAT (Cavnar y Trenkle 1994), XEROX (Beesley 1988) y (Grefenstette 1995) y Acquaintance (Damashek 1995) del idioma Textos muy cortos 4550 documentos muy cortos (1 a 100 palabras) construidos a partir de los temas CLEF de 2003 (alemán, castellano, finés, francés e inglés) y 2004 (también italiano y sueco). blindLight resultó mejor que TEXTCAT (hasta 20 palabras) y Acquaintance (hasta 5 palabras); análogo a XEROX para textos de más de 6 palabras. Textos con ruido Colección 1500-5LNG. 1500 artículos publicados en soc.culture.basque, catalan, french, galiza y german. Finalmente, se emplearon 1358 artículos escritos en alemán, castellano, catalán, francés, inglés, italiano y vasco, incluyendo las cabeceras. blindLight mejora a TEXTCAT para niveles de ruido superiores al 50% pero XEROX es sustancialmente mejor para un ruido superior al 50% y Acquaintance es sustancialmente mejor para más del 35% de ruido. 69%

- 46. Categorización de documentos con blindLight El problema de los 85 artículos publicados durante 1787 y 1788 en periódicos del estado de Nueva Federalist Papers York para convencer a sus votantes sobre la necesidad de ratificar la futura (atribución de autoría) constitución de EE.UU. Aparecieron bajo el pseudónimo de Publius y fueron escritos por Alexander Hamilton, James Madison y John Jay. Se llegó a un consenso sobre la autoría de cada artículo a excepción de 12, sobre los cuales sólo se estaba de acuerdo en que eran de Hamilton o de Madison. Mosteller y Wallace (1964) concluyeron, por métodos estadísticos, que los doce artículos en disputa eran obra de Madison. Diversas técnicas de categorización se han aplicado a dicho problema con idénticos resultados (redes neuronales, cadenas de Markov, SVMs, …) Aplicando blindLight se alcanzan las mismas conclusiones. 70%

- 47. Categorización de documentos con blindLight Filtrado de correo no Spam es el correo que recibe un usuario sin haberlo solicitado previamente. deseado o spam El filtrado de spam consiste en asignar una etiqueta de dos posibles a cada mensaje recibido: ham (correo válido) o spam (correo no deseado). Los categorizadores bayesianos (que no son la mejor técnica de categorización posible) son los mejor considerados para filtrar spam (Androutsopoulos et al. 2000). Para evaluar blindLight como técnica de filtrado de spam se han empleado dos colecciones (ling-spam y spamassassin). “Es necesario investigar Como técnica de filtrado de spam (mover o borrar mensajes etiquetados como no técnicas que permitan deseados) blindLight no resulta adecuada por el momento. controlar y filtrar la información que llega a las En cuanto a simple experimento de categorización (simplemente etiquetar los mensajes) personas que deban la técnica proporciona unos resultados (precisión y exhaustividad) próximos a los de los usarla” (Denning 1982) categorizadores bayesianos y MBL (Memory Based Learning). 72%

- 48. Categorización de documentos con blindLight Colecciones estándar Para poder comparar blindLight con otras técnicas se han empleado las colecciones Reuters-21578 y Reuters-21578 (artículos periodísticos) y OHSUMED (artículos médicos). OHSUMED La primera colección asigna a cada documento etiquetas de un conjunto de 135 posibles (p.ej. trade, corn o crude). La segunda toma las etiquetas de la clasificación MESH - Medical Subject Headings (p.ej. virus diseases, eye diseases o neoplasms). En el primer caso se empleó una partición de la colección con 9603 documentos de entrenamiento y 3299 de prueba. En el segundo se utilizaron 20000 documentos. Los resultados obtenidos se compararon con los alcanzados por Joachims (1997) y Dumais et al. (1998) comprobándose que blindLight alcanza resultados análogos a los de Rocchio, categorizadores bayesianos o árboles de decisión; próximos a los de k-vecinos y sustancialmente peores que SVMs. 73%

- 49. Categorización de documentos con blindLight En conclusión… “La utilización de blindLight como método de categorización de documentos no alcanza los resultados de las SVMs pero es análogo a otras técnicas empleadas con frecuencia y comunmente aceptadas como muy adecuadas (p.ej. clasificadores Bayesianos).” 75%

- 50. Recuperación de información con blindLight Sistemas de “Un sistema de recuperación de información (IR) no informa al usuario acerca del tema recuperación de de su consulta, es decir, no modifica sus conocimientos; simplemente indica la información y su existencia (o inexistencia) y localización de documentos relativos a dicha consulta.” (Lancaster 1968) evaluación Idealmente, un sistema IR debería proporcionar sólo documentos relevantes para las consultas que recibiese. En la práctica se acepta que el objetivo es localizar el mayor número posible de documentos relevantes y el menor de documentos irrelevantes. La relevancia de un documento es subjetiva y cambiante pero, en un marco experimental, es factible determinar, para un conjunto de consultas de prueba, qué documentos de una colección son relevantes. Existen colecciones estándar para la evaluación de sistemas IR. En la actualidad, énfasis en colecciones de gran tamaño y contextos bi- y multilingües. 78%

- 51. Recuperación de información con blindLight blindLight como La aplicación de blindLight como método IR es muy sencilla: técnica IR Documentos y consultas se representan como vectores de n-gramas y significatividades que pueden combinarse para obtener los valores de y . A partir de dichos valores se calcula una medida de similitud que se empleará para ordenar la lista de resultados. El número de n-gramas de consultas y documentos son generalmente muy diferentes y, por tanto, los valores y no son directamente comparables; por ello se ha experimentado con diversas medidas de similitud. Además, ya que la importancia de un término es inversamente proporcional al número de documentos que lo contienen (Maron y Kuhns 1960) (Spärck-Jones 1972) se han estudiado diversas formas de ponderar este hecho en blindLight. También se han analizado varios estadísticos para el cálculo de la significatividad de los n-gramas (la información mutua parece uno de los más adecuados). 80%

- 52. Recuperación de información con blindLight Comparación con Para comparar el rendimiento de blindLight con otras técnicas IR se desarrollaron una otras técnicas serie de experimentos sobre las colecciones CACM y CISI (Fox 1983) y se participó en CLEF 2004 (Peters et al. 2005). El primer experimento proporcionó datos que fueron comparados con resultados recogidos en la literatura. Los resultados obtenidos por blindLight aún son inferiores a los alcanzados por modelos como el vectorial o el probabilístico pero comparables a los proporcionados por técnicas como la semántica latente. La participación en CLEF permitió enfrentar la técnica a un problema de mayor envergadura, obligó al desarrollo de una técnica de pseudo-traducción y proporcionó información sobre la situación de blindLight en relación con los métodos más avanzados disponibles. 81%

- 53. Recuperación de información con blindLight Comparación con blindLight participó en CLEF 2004 en dos tareas otras técnicas Recuperación de información monolingüe en ruso (CLEF 2004) Recuperación de información bilingüe consultando en castellano la colección de documentos escritos en inglés Los resultados obtenidos no fueron buenos pero aún no se empleaba ningún método de ponderación interdocumental y el sistema de pseudo-traducción aún estaba (está) en una fase de desarrollo incipiente. Finalizada la campaña se realizaron una serie de pruebas “no oficiales” de recuperación monolingüe en finés, francés y ruso. Los resultados alcanzados con las nuevas modificaciones son mejores pero aún distan de los proporcionadas por técnicas consolidadas. Aún así… alentador. 83%

- 54. Recuperación de información con blindLight Comparación con Finés Monolingüe (Topic + Description) Ruso Monolingüe (Topic + Description) Francés Monolingüe (Topic + Description) 1,0 1 1 otras técnicas 0,8 0,8 0,8 (CLEF 2004) 0,6 0,6 0,6 Precisión Precisión Precisión 0,4 0,4 0,4 0,2 0,2 0,2 0,0 0 0 0,0 0,2 0,4 0,6 0,8 1,0 0,0 0,2 0,4 0,6 0,8 1,0 0,0 0,2 0,4 0,6 0,8 1,0 Exhaustividad Exhaustividad Exhaustividad bL-SCP-s4 bL-SCP-wS4 bL-SCP-s4 bL-SCP-wS4 bL-SI-s2 bL-SI-wS2 bL-SCP-s4 bL-SCP-wS4 bL-SI-s2 bL-SI-wS2 Media CLEF'04 5 Mejores CLEF'04 bL-SI-s2 bL-SI-wS2 Media CLEF'04 5 Mejores CLEF'04 uoviRU (oficial) bL-4g-SI-wS2 Media CLEF'04 5 Mejores CLEF'04 bL-4g-SI-wS2 bL-5g-SI-wS2 bL-5g-SI-wS2 bL-SI-4g-wS2 bL-SI-5g-wS2 84%

- 55. Recuperación de información con blindLight blindLight como Método de pseudo-traducción de consultas (Gayo Avello et al. 2004) no obtiene texto técnica CLIR traducido de la consulta sino un vector de n-gramas que, probablemente, (Cross Language IR) aparecerían en el correspondiente a la consulta traducida. Cierta semejanza con técnicas de Pirkola et al. (2002) y McNamee y Mayfield (2003). La técnica requiere un corpus paralelo (p.ej. EuroParl) de los idiomas fuente (F) y objeto (O) alineado a nivel de sentencia y procede del modo siguiente Una consulta escrita en el lenguaje fuente, QF, se divide en secuencias de palabras de longitud variable. Se explora el corpus F en busca de sentencias que contengan alguna de dichas secuencias. Cada sentencia encontrada en F (máximo k) es reemplazada por su homóloga en el corpus O. Para cada homóloga en O se obtiene un vector de n-gramas. Todos estos vectores se intersecan. Los vectores obtenidos por intersección se mezclan en un vector consulta pseudo-traducido. 86%

- 56. Recuperación de información con blindLight blindLight como Consulta original Encontrar documentos en los que se habla de las discusiones sobre la técnica CLIR reforma de las instituciones financieras y, en particular, del Banco (Cross Language IR) Mundial y del FMI durante la cumbre de los G7 que se celebró en Halifax en 1995. Fragmentos de la consulta a buscar en el corpus F (castellano) … instituciones instituciones financieras … Sentencias del corpus F que contienen el fragmento anterior (1315) …relaciones con las instituciones financieras internacionales… (5865) …fortalecimiento de las instituciones financieras internacionales… (6145) …transparente para que las instituciones financieras europeas… 88%

- 57. Recuperación de información con blindLight blindLight como Sentencias homólogas en el corpus O (inglés) (1315) …relationships with the international financial institutions… técnica CLIR (5865) …strengthening international financial institutions… (Cross Language IR) (6145) …transparent mechanism so that the European financial institutions… Intersección de los vectores correspondientes a las sentencias homólogas en O {' fi', ' in', 'al ', 'anc', 'cia', 'fin', 'ial', 'ina', 'ins', 'ion', 'itu', 'l i', 'nan', 'nci', 'nst', 'ons', 'sti', 'the', 'tio', 'tit', 'tut', 'uti'}} Vector final correspondiente a la pseudo-traducción de la consulta {'Ban', 'ank', 'Wor', 'ld ', ..., 'd B', 'Hal', 'ali„, 'ifa', 'fax', ..., 'cum', 'umb', 'mbr', 'bre', ..., 'sio', 'uss', 'ard', 'rds', 'ax ', 'IMF', ..., 'FMI', ..., 'G7 ', 'the', ..., ' th', 'n t'} Solapamiento entre el vector pseudo-traducido y la hipotética traducción Find documents about discussions on the reform of financial institutions, and in particular the World Bank and the IMF, at the G7 summit that took place in Halifax in 1995 89%

- 58. Recuperación de información con blindLight En conclusión… “La utilización de blindLight como técnica de recuperación de información es viable ofreciendo, además, un método de pseudo-traducción de consultas que lo hace muy interesante para entornos multilingües. Los resultados obtenidos por el momento no son tan satisfactorios como los que proporcionan técnicas afianzadas; no obstante, son similares a los de métodos considerados „prometedores‟ y hay una serie de puntos donde se podrá mejorar la técnica alcanzando rendimientos superiores.” 91%

- 59. Resumen automático con blindLight Resumen Conjunto de técnicas que producen para un texto de entrada un documento de salida más automático corto pero que contiene los puntos más relevantes del original. Luhn (1958) y Edmundson (1969) desarrollaron los primeros sistemas de “extracción de resúmenes”. Los sistemas de resumen automático más comunes son los “extractivos” (o de “cortar-y- pegar”) por oposición a los “abstractivos” que producen un texto nuevo que recoge las mismas ideas que el original sin extraer ninguna sentencia del mismo. DUC (Document Understanding Conferences) surgió como un marco para la evaluación y mejora de sistemas de resumen automático. Desde 2004 la evaluación se realiza automáticamente mediante la herramienta ROUGE (Lin 2004). A fin de evaluar blindLight como sistema de extracción de resúmenes se han empleado los productos de DUC 2004. 92%

- 60. Resumen automático con blindLight blindLight como Inspirado en el proceso de traducción y síntesis de las proteínas. técnica de resumen Se emplea tanto el vector de n-gramas como el texto plano del documento. extractivo El “ADN documental” está codificado mediante un vector de n-gramas de caracteres, cada uno de los cuales tiene asociado un peso. Cada par (n-grama, significatividad) puede emplearse a modo de ARNt. El texto plano no proporciona información sobre la relevancia de los distintos pasajes pero puede procesarse secuencialmente y el “ARNt documental” puede transferir significatividad a dicho texto. Este proceso no se realiza en una única fase sino en varias pasadas garantizando que la significatividad media por carácter sea creciente. Así, el texto de partida es “troceado” en fragmentos (chunks) de máxima significatividad que pueden utilizarse posteriormente para obtener palabras clave o para facilitar la extracción de las sentencias más relevantes. 94%

- 61. Resumen automático con blindLight blindLight como La Comisión ha adoptado hoy propuestas relativas a un paquete de medidas destinadas a reforzar técnica de resumen la capacidad de respuesta de la Unión Europea en caso de catástrofes. Estas medidas se destinan a financiar nuevos equipos especializados en materia de planificación para agilizar el suministro eficaz de extractivo ayuda a largo plazo; a reforzar la capacidad de la Unión de facilitar equipos de expertos civiles y de equipo y a suministrar ayuda humanitaria. La Comunicación adoptada hoy también presenta un informe detallado sobre la utilización de los 450 millones de euros anunciados por la UE tras la catástrofe del “Palabras” clave tsunami. Las propuestas adoptadas hoy constituyen la contribución de la Comisión al plan de acción catástrofes tras el tsunami propuesto por la Presidencia luxemburguesa el 31 de enero. catástrofe «Vistas las situaciones anteriores y nuestra capacidad de responder inmediatamente ante la a Comisión catástrofe del tsunami, la Comisión propone ahora medidas que nos ayudarán, en el futuro, a contribuir la Comisión de forma rápida y eficaz a las tareas de reconstrucción tras una catástrofe» ha declarado el tsunam la Comisaria de Relaciones Exteriores y Política de Vecindad, Benita Ferrero-Waldner, que propone dichas medidas conjuntamente con los Comisarios Michel y Dimas. Stavros Dimas, Comisario Europeo eficaz responsable de Protección Civil ha dicho: «Nuestra reacción ante el Tsunami ha demostrado el claro medidas valor añadido que la dimensión europea aporta a la asistencia en materia de protecci ón civil. Las equipos propuestas de hoy hacen avanzar un paso más al Mecanismo actual... Tomadas en su conjunto, la capacida permitirán disponer de un instrumento que garantiza una reacci ón europea eficaz ante futuras cción catástrofes». 95%

- 62. Resumen automático con blindLight Resultados de DUC 2004 fue la primera edición de DUC con evaluación automática y susceptible de blindLight en las facilitar pruebas “no oficiales”. tareas DUC 2004 Tareas Resúmenes muy cortos, máximo 75 caracteres, a partir de un único documento. Resúmenes cortos, máximo 665 caracteres, a partir de un conjunto de documentos. blindLight como método de extracción de palabras clave sin tratar de construir un “titular” legible ofrece resultados similares a los de la mayor parte de tecnologías disponibles. blindLight, al igual que el resto de técnicas, se encuentra muy lejos de alcanzar los resultados de un sistema tan sencillo como extraer los primeros caracteres de un artículo a la hora de construir una frase resumen de 75 caracteres. En cuanto a resúmenes de mayor longitud pero igualmente cortos (máximo 665 caracteres) se puede afirmar que blindLight es, cuando menos, apreciablemente mejor que muchas de las tecnologías disponibles. 97%

- 63. Resumen automático con blindLight En conclusión… “blindLight es una herramienta útil para la extracción de resúmenes automáticos a partir de texto libre escrito en cualquier lenguaje natural. Su aplicación para la obtención de resúmenes muy cortos no parece adecuada pero muy pocas técnicas consiguen superar la eficacia de un método tan sencillo como extraer los primeros caracteres del documento. Por lo que respecta a la extracción de resúmenes cortos su rendimiento es superior a muchas de las técnicas más avanzadas disponibles En cuanto a la invariabilidad de los resultados respecto al idioma a resumir las pruebas preliminares indican que es bastante elevada y parece posible alcanzar buenos resultados en cualquier lenguaje natural.” 98%

- 64. Conclusiones y trabajo futuro blindLight es una técnica novedosa para el procesamiento de lenguaje natural por medios puramente estadísticos. Es aplicable a múltiples idiomas ofreciendo resultados consistentes en todos ellos, muestra una adecuada tolerancia al ruido y resulta apta para tareas de clasificación, categorización y extracción de resúmenes. Además, parece potencialmente útil para la recuperación de información en entornos multilingües aunque en este campo aún no se ha progresado lo suficiente. 99%

- 65. Conclusiones y trabajo futuro El futuro… Adaptar el sistema de extracción de resúmenes a entornos multidocumento. Continuar el desarrollo del sistema de pseudo-traducción. Analizar la posible integración de los dos sistemas anteriores. Emplear programación genética para la obtención de nuevas medidas de similitud entre documentos y consultas en el sistema IR. Estudiar la posible integración de medidas basadas en la complejidad de Kolmogorov. Estudiar la utilización de fragmentos de significatividad máxima como términos de indexado en el sistemas IR. 100%

- 66. Gracias por su paciencia…

- 67. Referencias Abir et al. 2002 Abir, E., Klein, S., Miller, D. y Steinbaum, M. 2002, “Fluent Machines’ EliMT System”, en S.D. Richardson (Ed.): AMTA 2002, LNAI 2499, pp. 216- 219. Androutsopoulos et al. 2000 Androutsopoulos, I., Koutsias, J., Chandrinos, K.V., Paliouras, G. y Spyropoulos, C.D. 2000a, “An Evaluation of Naive Bayesian Anti-Spam Filtering”, [Online], en Potamias, G., Moustakis, V. y van Someren, M. (Eds.): Proceedings of the Workshop on Machine Learning in the New Information Age, pp. 9-17, disponible en: <http://www.aueb.gr/users/ion/docs/mlnet_paper.pdf> [30 Junio 2005] Attardi et al. 1999 Attardi, G., Gullì, A. y Sebastiani, F. 1999, “Theseus: Categorization by context”, en Proceedings of WWW8, pp. 136-137 Balabanovic et al. 1995 Balabanovic, M., Shoham, Y. y Yun, Y. 1995, An adaptive agent for automated web browsing, Informe técnico, Stanford University. Balabanovic 1998 Balabanovic, M. 1998, “An interface for learning multi-topic user profiles from implicit feedback”, en Proceedings of AAAI Workshop on Recommender Systems, pp. 6-10. Beesley 1988 Beesley, K.R. 1988, “Language identifier: A computer program for automatic natural-language identification on on-line text”, en Proceedings of the 29th Annual Conference of the American Translators Association, pp. 47-54.

- 68. Referencias Berners-Lee 1989 Berners-Lee, T. 1989, Information Management: A Proposal, Informe técnico, CERN. Berners-Lee et al. 2001 Berners-Lee, T., Hendler, J. y Lassila, O. 2001, “The Semantic Web”, Scientific American, vol. 284, no. 5, pp. 34-43. Bharat y Henzinger 1998 Bharat, K., y Henzinger, M. 1998, “Improved Algorithms for Topic Distillation in a Hyperlinked Environment”, en Proceedings of SIGIR-98, 21st ACM International Conference on Research and Development in Information Retrieval, pp. 104-111. Bray y Curtis 1957 Bray, J.R. y Curtis, J.T. 1957, “An ordination of the upland forest communities of southern Wisconsin”. Ecological Monographs, 27, pp. 325-349. Brin y Page 1998 Brin, S. y Page, L. 1998, “The Anatomy of a Large-Scale Hypertextual Web Search Engine”, Computer Networks and ISDN Systems, vol. 30, no. 1-7, pp. 107-117. Broder 2002 Broder, A. 2002, “A taxonomy of web search”, ACM SIGIR Forum, vol. 36, no. 2, pp. 3-10.

- 69. Referencias Cavnar y Trenkle 1994 Cavnar, W.B. y Trenkle, J.M. 1994, “N-Gram-Based Text Categorization”, en Proceedings of SDAIR-94, 3rd Annual Symposium on Document Analysis and Information Retrieval, pp. 161-175. Chekuri et al. 1997 Chekuri, C., Goldwasser, M.H., Raghavan, P. y Upfal, E. 1997, “Web Search Using Automatic Classification”, en Sixth International World Wide Web Conference. Chen et al. 1999 Chen, X., Kwong, S. y Li, M. 1999, “A Compression Algorithm for DNA Sequences and its Applications in Genome Comparison”, en Proceedings of the 10th Workshop on Genome Informatics (GIW'99), pp. 51-61. Cohen 1995 Cohen, J.D. 1995, “Highlights: Language and Domain-Independent Automatic Indexing Terms for Abstracting”, JASIS, 46(3), pp. 162-174. Cohen 1996 Cohen, W. 1996, “Learning rules that classify email”, en Proceedings of the IEEE Spring Symposium on Machine Learning for Information Access. Damashek 1995 Damashek, M. 1995, Gauging Similarity via N-Grams: Language-Independent Sorting, Categorization, and Retrieval of Text. Departamento de Defensa, EE.UU.

- 70. Referencias Denning 1982 Denning, P.J. 1982, “Electronic junk”, CACM, vol. 25, no. 3, pp. 163-165. Duda y Hart 1973 Duda, R.O. y Hart, P.E. 1973, Pattern Classification and Scene Analysis, John Wiley and Sons, Inc. Dumais et al. 1988 Dumais, S.T., Furnas, G.W., Landauer, T.K., Deerwester, S. y Harshman, R. 1988, “Using Latent Semantic Analysis to improve access to textual information”, en Human Factors in Computing Systems, CHI‟88 Conference Proceedings, pp. 281-285. Dumais et al. 1998 Dumais, S.T., Platt, J., Heckerman, D. y Sahami, M. 1998, “Inductive learning algorithms and representations for text categorization”, en Proceedings of ACM-CIKM98, pp. 148-155. Dunning 1993 Dunning, T. 1993, “Accurate methods for the statistics of surprise and coincidence”, en Computational Linguistics, vol. 19, no. 1, pp. 61-74. Edmundson 1969 Edmundson, H.P. 1969, “New methods in automatic abstracting”, Journal of the ACM, vol. 16, no. 2, pp. 264-285.

- 71. Referencias Fan et al. 2004a Fan, W., Gordon, D. y Pathak, P. 2004a, “A generic ranking function discovery framework by genetic programming for information retrieval”, Information Processing and Management, vol. 40, no. 4, pp. 587-602. Fan et al. 2004b Fan, W., Gordon, D. y Pathak, P. 2004b, “Discovery of context-specific ranking functions for effective information retrieval using genetic programming”, IEEE Transactions on Knowledge and Data Engineering, vol. 16, no. 4, pp. 523-527. Ferreira da Silva y Pereira Lopes 1999 Ferreira da Silva, J., Pereira Lopes, G. 1999, “A Local Maxima method and a Fair Dispersion Normalization for extracting multi-word units from corpora”, en Proceedings of MOL6, pp. 369-381. Flake et al. 2003 Flake, G.W., Pennock, D.M. y Fain, D.C. 2003, “The Self-Organized Web: The Yin to the Semantic Web’s Yang”, IEEE Intelligent Systems, vol. 18, no. 4, pp. 75-77. Fox 1983 Fox, E. 1983. Characteristics of Two New Experimental Collections in Computer and Information Science Containing Textual and Bibliographic Concepts, Informe técnico, Cornell University.

- 72. Referencias Furnas et al. 1987 Furnas, G.W., Landauer, T.K., Gómez, L.M. y Dumais, S.T. 1987, “The vocabulary problem in humansystem communication”, Communications of the ACM, vol. 30, no. 11, pp. 964-971. Gayo Avello 2002 Gayo Avello, D. 2002, Web Cooperativa. Trabajo de investigación. Gayo Avello y Álvarez Gutiérrez 2002 Gayo Avello, D. y Álvarez Gutiérrez, D. 2002, “The Cooperative Web: A Complement to the Semantic Web”, en Proceedings of the 26th Annual International Computer Software & Applications Conference (COMPSAC‟02), pp. 179-183. Gayo Avello et al. 2004 Gayo Avello, D., Álvarez Gutiérrez, D. y Gayo Avello, J. 2004c, “Application of variable length n-grams to monolingual and bilingual information retrieval”, en Peters, C. y Borri, F. (Eds.): Working Notes for the CLEF 2004 Workshop. Gayo Avello 2005 Gayo Avello, D. 2005, blindLight: Una nueva técnica para procesamiento de texto no estructurado mediante vectores de n-gramas de longitud variable con aplicación a diversas tareas de tratamiento de lenguaje natural. Disertación doctoral. Goldberg et al. 1992 Goldberg, D., Nichols, D., Oki, B.M. y Terry, D. 1992, “Using Collaborative Filtering to Weave an Information Tapestry”, Communications of the ACM, vol. 35, no. 12, pp. 61-70.

- 73. Referencias Grefenstette 1995 Grefenstette, G. 1995, “Comparing two language identification schemes”, en Proceedings of 3rd International Conference on Statistical Analysis of Textual Data. Han et al. 1998 Han, E., Boley, D., Gini, M., Gross, R., Hastings, K., Karypis, G., Kumar, V., Mobasher, B. y Moore, J. 1998, “WebACE: A Web Agent for Document Categorization and Exploration”, en Proceedings of the 2nd International Conference on Autonomous Agents (Agents‟98), pp. 408-415. IPA 1999 IPA (International Phonetic Association) 1999, Handbook of the International Phonetic Association : A Guide to the Use of the International Phonetic Alphabet, Cambridge University Press, Reino Unido. Jansen et al. 1998 Jansen, B.J., Spink, A., Bateman, J. y Saracevic, T. 1998, “Real life information retrieval: A study of user queries on the web”, SIGIR Forum, vol. 32, no. 1, pp. 5-17. Jansen y Spink 2003 Jansen, B.J. y Spink, A. 2003, “An Analysis of Web Documents Retrieved and Viewed”, The 4th International Conference on Internet Computing, pp. 65-69.

- 74. Referencias Jarvis y Patrick 1973 Jarvis, R.A. y Patrick, E.A. 1973, “Clustering Using a Similarity Measure Based on Shared Near Neighbors”, IEEE Transactions on Computers, pp. 1025-1034. Joachims 1997 Joachims, T. 1997, “A probabilistic analysis of the Rocchio algorithm with TFIDF for text categorization”, en Proceedings of the 14th International Conference on Machine Learning, pp.143-151. Kantor et al. 2000 Kantor, P.B., Boros, E., Melamed, B., Menkov, V., Shapira, B. y Neu, D.J. 2000, “Capturing human intelligence in the Net”, Communications of the ACM, vol. 43, no. 8, pp. 112-115. Kleinberg 1998 Kleinberg, J.M. 1998, “Authoritative sources in a hyperlinked environment”, en Proceedings of the ninth annual ACM-SIAM symposium on Discrete algorithms, pp. 668-677. Konstan et al. 1997 Konstan, J.A., Miller, B.N., Maltz, D., Herlocker, J.L., Gordon, L.R. y Riedl, J. 1997, “GroupLens: Applying Collaborative Filtering to Usenet News”, Communications of the ACM, vol. 40, no. 3, pp. 77-87. Lancaster 1968 Lancaster, F.W. 1968, Information Retrieval Systems: Characteristics, Testing and Evaluation, Wiley, EE.UU.

- 75. Referencias Li et al. 1999 Li, W.S., Vu, Q., Chang, E., Agrawal, D., Hara, Y. y Takano, H. 1999, “PowerBookmarks: A System for Personalizable Web Information Organization, Sharing, and Management”, en Proceedings of the Eighth International World-Wide Web Conference. Li et al. 2004 Li, M., Chen, X., Li, X., Ma, B. y Vitányi, P. 2004, “The Similarity Metric”, IEEE Transactions on Information Theory, vol. 50, pp. 3250-3264. Lieberman 1995 Lieberman, H. 1995, “Letizia: An Agent That Assists Web Browsing”, en Proceedings of the Fourteenth International Joint Conference on Artificial Intelligence, pp. 924-929. Lin 2004 Lin, C.Y. 2004, “Rouge: A Package for Automatic Evaluation of Summaries”, en Text Summarization Branches Out: Proceedings of the ACL-04 Workshop, pp. 74-81. Luhn 1958 Luhn, H.P. 1958, “The Automatic Creation of Literature Abstracts”, IBM Journal of Research and Development, vol. 2, no. 2, pp. 159-165. Maarek y Ben Shaul 1996 Maarek, Y.S. y Ben Shaul, I.Z. 1996, “Automatically Organizing Bookmarks per Contents”, en Proceedings of the 5th International World Wide Web Conference.

- 76. Referencias Manber 1996 Manber, U. 1996, “Future Directions and Research Problems in the World Wide Web (Abstract)”, en Proceedings of the Fifteenth ACM SIGACT- SIGMOD-SIGART Symposium on Principles of Database Systems, pp. 213-215. Maron y Kuhns 1960 Maron, M.E. y Kuhns, K.L. 1960, “On relevance, probabilistic indexing and information retrieval”, Journal of the ACM, vol. 7, no. 3, pp. 216-244. McNamee y Mayfield 2003 McNamee, P. y Mayfield, J. 2003, “JHU/APL Experiments in Tokenization and Non-Word Translation”, Working Notes for the CLEF 2003 Workshop. 21-22 August, Trondheim, Norway. Merkl y Rauber 1998 Merkl, D. y Rauber, A. 1998, “CIA’s View of the World and What Neural Networks Learn from It: A Comparison of Geographical Document Space Representation Metaphors”, en Quirchmayr, G. et al. (Eds.): Database and Expert Systems Applications, 9th International Conference, LNCS 1460, pp. 816-825 Morita y Shinoda 1994 Morita, M. y Shinoda, Y. 1994, “Information filtering based on user behavior analysis and best match text retrieval”, en Proceedings of the 17th Annual International Retrieval, pp. 272-281. Mosteller y Wallace 1964 Mosteller, F. y Wallace, D.L. 1964, “Inference and Disputed Authorship: The Federalist Series”, en Behavioral Science: Quantitative Methods.

- 77. Referencias Muthukrishnan y Sahinalp 2000 Muthukrishnan, S. y Sahinalp, S.C. 2000, “Approximate nearest neighbors and sequence comparison with block operations”, en Proceedings of the thirty-second annual ACM symposium on Theory of computing, pp. 416-424. Page et al. 1998 Page, L., Brin, S., Motwani, R. y Winograd, T. 1998, The PageRank Citation Ranking: Bringing Order to the Web, [Online], Stanford University, Disponible en: <http://dbpubs.stanford.edu/pub/1999-66> [30 Junio 2005]. Peters et al. 2005 Peters, C., Clough, P.D., Jones, G.J.F., Gonzalo, J., Kluck, M. y Magnini, B. (Eds.) 2005, Multilingual Information Access for Text, Speech and Images: Results of the 5th CLEF Evaluation Campaign, LNCS 3491. Pirkola et al. 2002 Pirkola, A, Keskustalo, Heikki, Leppänen, Erkka, Känsälä, Antti-Pekka and Järvelin, Kalervo, 2002, “Targeted s-gram matching: a novel n-gram matching technique for cross- and monolingual word form variants”, Information Research, vol. 7, no. 2. Prud'hommeaux y Seaborne 2005 Prud’hommeaux, E. y Seaborne, A. (Eds.) 2005, SPARQL Query Language for RDF, [Online], Borrador de trabajo, Consorcio W3, Disponible en: <http://www.w3.org/TR/rdf-sparql-query/> [8 Noviembre 2005].

- 78. Referencias Rubner et al. 2000 Rubner, Y., Tomasi, C. y Guibas, L.J. 2000, “The Earth Mover’s Distance as a Metric for Image Retrieval”, International Journal of Computer Vision, vol. 40, no. 2, pp. 99-121. Rucker y Marcos 1997 Rucker, J. y Marcos, J.P. 1997, “Siteseer: Personalized Navigation for the Web”, Communications of the ACM, vol. 40, no. 3, pp. 73-75. Sahami et al. 1998 Sahami, M., Dumais, S., Heckerman, D. y Horvitz, E. 1998, “A bayesian approach to filtering junk e-mail”, en AAAI-98 Workshop on Learning for Text Categorization. Salton 1972 Salton, G. 1972, Automatic processing of current afairs queries, Informe Técnico, Cornell University. Schütze et al. 1995 Schütze, H., Hull, D.A. y Pedersen, J.O. 1995, “A comparison of classi.ers and document representations for the routing problem”, en Proceedings of SIGIR-95, 18th ACM International Conference on Research and Development in Information Retrieval, pp. 229-237. Silverstein et al. 1998 Silverstein, C., Henzinger, M., Marais, H. y Moricz, M. 1998, Analysis of a Very Large AltaVista Query Log, Informe técnico, Digital Systems Research Center.

- 79. Referencias Spärck-Jones 1972 Spärck-Jones, K. 1972, “A statistical interpretation of term specificity and its application in retrieval”, Journal of Documentation, vol. 28, no. 1, pp. 11-21. Varré et al. 1999 Varré, J.S., Delahaye, J.P. y Rivals, É. 1999, “The Transformation Distance: A Dissimilarity Measure Based on Movements of Segments”, Bioinformatics, vol. 15, no. 3, pp 194-202.