Polybase y su uso en la integración de almacenes de datos

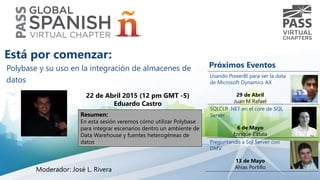

- 1. Polybase y su uso en la integración de almacenes de datos 22 de Abril 2015 (12 pm GMT -5) Eduardo Castro Resumen: En esta sesión veremos cómo utilizar Polybase para integrar escenarios dentro un ambiente de Data Warehouse y fuentes heterogéneas de datos Está por comenzar: Próximos Eventos Moderador: José L. Rivera Usando PowerBI para ver la data de Microsoft Dynamics AX 29 de Abril Juan M Rafael SQLCLR .NET en el core de SQL Server 6 de Mayo Enrique Cátala Preguntando a Sql Server con DMV 13 de Mayo Ahias Portillo

- 2. Manténgase conectado a nosotros! Visítenos en http://globalspanish.sqlpass.org /SpanishPASSVC lnkd.in/dtYBzev /user/SpanishPASSVC /SpanishPASSVC

- 3. 3

- 4. 4 Oportunidades de Voluntariado PASS no pudiera existir sin personas apasionadas y dedicadas de todas partes del mundo que dan de su tiempo como voluntarios. Se un voluntario ahora!! Para identificar oportunidades locales visita volunteer.sqlpass.org Recuerda actualizar tu perfil en las secciones de “MyVolunteering” y MyPASS para mas detalles.

- 5. Sigan Participando! • Obtén tu membresía gratuita en sqlpass.org • Linked In: http://www.sqlpass.org/linkedin • Facebook: http://www.sqlpass.org/facebook • Twitter: @SQLPASS • PASS: http://www.sqlpass.org

- 6. Polybase y su uso en la integración de almacenes de datos 22 de Abril de 2015 Eduardo Castro, PhD. SQL Server MVP PASS Regional Mentor LATAM Comunidad Windows – Costa Rica Moderador: José L. Rivera

- 7. Fundamentos Polybase Escenarios Polybase • Hadoop para Staging • Exportación Dimensiones a Hadoop • Hadoop como Almacenamiento de Datos • Fuentes consultadas TechEd North America 2014 Agenda

- 8. ... Almacenamiento de datos ha alcanzado el punto de inflexión más importante desde su creación. La gestión de datos en TI está cambiando. Fuentes de datos El Datawarehouse de datos tradicional - Gartner, "El Estado de Data Warehousing en 2012

- 9. El Aumento volúmenes de datos 1 Tiempo real datos 2 Nuevos datos fuentes y tipos 3 Nacido en la nube datos 4 El Datawarehouse de datos tradicional Datos no relacionalesFuentes de datos

- 10. Fuentes de datos Datos no relacionales El Datawarehouse de datos moderno

- 11. Presentación de la Plataforma del sistema Microsoft Analytics El moderno dispositivo de almacenamiento de datos llave en mano Lista para la empresa Big Data Rendimiento de próxima generación a gran escala Diseñado para valor óptimo Datos relacionales y no relacionales en un solo dispositivo Hadoop listo para la empresa Consulta integrada a través de Hadoop y PDW usando T-SQL Integración directa con las herramientas de BI de Microsoft, como Microsoft Excel Rendimiento en tiempo real con In- Memory de columnas Capacidad de escalar para ajustarse a crecimiento de datos La eliminación de los cuellos de botella de almacenamiento de datos con SQL Server MPP Valor a través de una única solución de Appliance Opciones de hardware flexibles utilizando hardware comercial

- 12. Hardware y software de ingeniería juntos La facilidad de un Appliance Hardware incorporado Pre + dispositivo de software • Co-diseñado con Dell, HP, y Quanta • Hardware en la pre-construido • Software preinstalado Plug and play Mejores prácticas incorporadas Ahorro de tiempo Construido Big Data Analytics Platform System SQL Server Parallel Data Warehouse Microsoft HDInsight Polybase

- 13. Alto rendimiento y sintonizado en el Appliance Autenticación del usuario final con Active Directory Conocimientos accesibles para todas las personas con las herramientas de BI de Microsoft Manejar y controlar el uso de System Center 100 por ciento de Hadoop SQL Server Parallel Data Datawarehous e Microsoft HDInsight Polybase APS entrega lista para la empresa Hadoop con HDInsight

- 14. Parallel Data Warehouse carga de trabajo HDInsight carga de trabajo Fabric Hardware Appliance Una región es un contenedor lógico dentro de un Appliance Cada carga de trabajo contiene los siguientes límites: Seguridad Medida Mantenimiento Resumen Appliance APS

- 15. HDInsight Información general HDI se ejecuta en un Appliance en una carga de trabajo HDInsight es de marca Hortonworks para Microsoft distro (HDP1.3) Para AU1 Un dispositivo integrado para el funcionamiento de región y la región PDW HDI PDW se ofrece como una carga de trabajo autónomo en el Appliance HDI se ofrece sólo como un add-on para PDW Sólo soportado en hardware V2 H / A para el nodo principal en conmutación por error Nodo de Datos H / A es HDFS

- 16. ¿Qué incluye?

- 17. Topología Hardware Utiliza PDW HW y topología No hay nuevos SKUs para la región HDI 2 servidores adicionales en el RACK1 de HDI Head Node 1 activa / 1 de conmutación por error PDW Nodo de Control HDI Head Node HDI de datos Nodos (1 unidad de la escala) PDW nodos de computación (1 unidad de la escala) PDW PDW failover / repuesto Hadoop Failover Hadoop / repuesto Unidad de la escala pasiva para PDW U42 U41 U40 U39 U38 U37 U36 U35 U34 u33 u32 u31 u30 u29 u28 u27 u26 u25 u24 u23 u22 u21 u20 u19 u18 u17 u16 u15 u14 u13 u12 u11 u10 U9 u8 u7 u6 U5 u4 u3 u2 u1 DL360G8 servidor 670769-B21 DL360G8 servidor 670769-B21 DL360G8 servidor 670769-B21 DL360G8 servidor 670769-B21 Interruptor del IB 670769-B21 Interruptor del IB 670769-B21 Conmutador Ethernet JE068A Conmutador Ethernet JE068A DL360G8 servidor 654081-B21 JBOD D6000 DL360G8 servidor 670769-B21 DL360G8 servidor 670769-B21 JBOD D6000 DL360G8 servidor 654081-B21

- 18. Proporciona un único modelo de consulta T-SQL para PDW y Hadoop con características de T-SQL, incluyendo unión sin ETL Utiliza el poder del MPP para mejorar el rendimiento de ejecución de consultas Soporta Windows Azure HDInsight para permitir que los nuevos escenarios de nube híbrida Ofrece la posibilidad de consulta de Microsoft no distribuciones de Hadoop, como Hortonworks y Cloudera SQL Server Parallel Data Datawarehous e Microsoft Azure HDInsight Polybase Microsoft HDInsight Hortonworks para Windows y Linux Cloudera Conexión de islas de datos con Polybase Trayendo soluciones puntuales Hadoop y el Datawarehouse Result Set Seleccione ...

- 19. Polybase APS AU1 Las nuevas versiones de Hadoop Nuevos tipos de archivo Múltiples Conexiones Hadoop Predicado Pushdown

- 20. Cómo consultar cualquier dato, en cualquier lugar, en cualquier formato? Tablas Externas Fuentes de datos externas Formato de Archivo Externo

- 21. Concepto de tablas externas, fuentes y datos Formatos de archivo

- 22. Microsoft APS Polybase El control APS nodos de datos Social Sensor Y RFID MóvilWeb Polybase - El motor de consulta PDW Los científicos de datos, Usuarios de BI, DB Admins LOB PowerBI Polybase/ APS motor de consulta Tabla externa Datos externos fuente Formato de Archivo Externo Aplicaciones

- 23. Fuentes de datos externos CREATE EXTERNAL DATA SOURCE datasource_name {WITH (TYPE = <data_source>, LOCATION =‘<location>’, [JOB_TRACKER_LOCATION = ‘<jb_location>’] } [;] Lugar de origen de datos externo Tipo de fuente de datos externa La activación o desactivación de la generación de empleo MapReduce 1 2 3 Representación interna o una fuente de datos externa Soporte de Hadoop como fuente de datos y Windows Azure Blob de almacenamiento (WASB, antes conocido como ASV) Activación y desactivación de procesamiento query processing split-based Generación de trabajos MapReduce on-the-fly [totalmente transparente para el usuario final] Alterar los datos externa permiso fuente necesaria

- 24. Tablas externas CREATE EXTERNAL DATA SOURCE datasource_name {WITH (TYPE = <data_source>, LOCATION =‘<location>’, [JOB_TRACKER_LOCATION = ‘<jb_location>’] } [;]

- 25. Formato de archivo externo CREATE EXTERNAL FILE FORMAT fileformat_name {WITH ( FORMAT_TYPE = <type>, [SERDE_METHOD = ‘<sede_method>’] [DATA_COMPRESSION = ‘<compr_method>’] [FORMAT_OPTIONS (<format_options>)] } [;] (De) método de serialización [Hive RCFile] Tipo de fuente de datos externa Método de compresión Opciones (Opcional) Formato [Archivos de texto] 1 2 3 Representación interna de un formato de archivo externo Soporte de archivos de texto delimitados y Colmena de ficheros de recursos Activación y desactivación de procesamiento query processing split-based Generación de empleos MapReduce on-the-fly Alterar cualquier archivo externo permiso formato requerido 4

- 26. Las tablas externas CREATE EXTERNAL TABLE table_name ({<column_definition>}[,..n ]) {WITH (DATA_SOURCE = <data_source>, FILE_FORMAT = <file_format>, LOCATION =‘<file_path>’, [REJECT_VALUE = <value>], …} [;] Hacer referencia a formato de archivo externo Hacer referencia a la fuente de datos externa Ruta del archivo / carpeta Hadoop (Opcional) Rechazar parámetros 1 2 3 Representación interna de los datos que residen fuera del Appliance La introducción de la sintaxis (en comparación con Polybasev1) Actualización de tablas externas v1 existentes Permisos de SQL necesarios para crear tablas externas ADMINISTER BULK OPERATIONS, CREATE TABLE, and ALTER ON SCHEMA permission ALTER ANY EXTERNAL DATA SOURCE and FILE FORMAT permission 4

- 27. Soporte de formatos de archivo adicionales HDFS Hive RCFiles CREATE EXTERNAL FILE FORMAT MyRCFile WITH ( FORMAT_TYPE = ‘RCFile’, [SERDE_METHOD =‘LazyBinarySerDe’] ) Usuarios Hadoop / Hive prefieren RCFile debido a mejores beneficios de compresión y rendimiento Archivo columnas Record que consiste en pares binarios clave / valor El usuario tiene que especificar el método de serialización / deserialización (SERDE_METHOD) RCFile almacena columnas de una tabla en una forma de registro columnar Algunas observaciones de rendimiento • LazyBinaryColumnarSerDe significativamente más rápido y más eficiente que ColumnarSerDe • La compresión de datos no es muy beneficiosa en el caso de la conectividad entre IB Hadoop y PDW (Si se utiliza redes de baja velocidad, se espera que la compresión para ayudar)

- 28. Opciones de formato para archivos de texto delimitados <Format Options> :: = [,FIELD_TERMINATOR= ‘Value’], [,STRING_DELIMITER = ‘Value’], [,DATE_FORMAT = ‘Value’], [USE_TYPE_DEFAULT = ‘Value’] Field_terminator STRING_DELIMITER USE_TYPE_DEFAULTFORMATO DE FECHA Para indicar un delimitador de columna Para especificar el delimitador de campos de tipo de datos de cadena Para especificar un formato de fecha en particular Para especificar cómo faltan entradas en archivos de texto son tratados

- 29. (HDFS) Bridge Resultad os Acceso directo HDFS y paralelizado Mejoras en el servicio de movimiento de datos (DMS) de APS para permitir la comunicación directa entre los nodos de datos HDFS y nodos de computación PDW Los datos no relacionales Social aplicaciones Sensor y RFID Móvil aplicaciones Web aplicaciones Hadoop Datos relacionales PDWHDFS Brigde Mejorado motor de consulta PDW La tabla externa Los datos externos fuente Archivo externo formato Regular T-SQL Aplicaciones de almacenamiento de datos basado en esquemas tradicionales

- 30. Consulta Hadoop externa datos a través de T-SQL

- 31. Predicado Pushdown Reducir el movimiento de datos Reducir el número de filas movido Reducir el número de columnas movido Subconjunto de expresiones y operadores

- 32. Consulta los datos de Hadoop través de T-SQL Datos de consulta en HDFS y mostrar los resultados en forma de tabla (vía tablas externas) Úne datos de HDFS con APS relacional / datos PDW Ejemplo Running - Creación de tabla externa 'ClickStream': CREATE TABLE EXTERNO ClickStream(url varchar(50), fecha del evento fecha de, user_ip varchar(50)), JUNTO CON (UBICACIÓN= "//Hadoop_files/clickstream.tbl', FUENTE DE DATOS= MY_HDP2.0,FORMATO DE ARCHIVO=MyDelimitedText) Fuente de datos externa y formato de archivo Polybase ejemplos de consulta SELECT top 10 (url) FROM ClickStream where user_IP = ‘192.168.0.1’ Consulta de filtro contra datos en HDFS SELECT url.description FROM ClickStream cs, Url_Descr* url WHERE cs.url = url.name and cs.url=’www.cars.com’; Union de datos de varios archivos en HDFS (*Url_Descr es un segundo archivo de texto) SELECT user_name FROM ClickStream cs, User* u WHERE cs.user_IP = u.user_IP and cs.url=’www.microsoft.com’; Union de datos de HDFS con datos en PDW (* El usuario es una tabla PDW distribuida) 1 2 3

- 33. Ejecución de la consulta basada en Split de Polybase (HDFS / WASB) Puente de componentes Conexión y recuperación / escritura de datos desde / al sistema de archivos distribuido de Hadoop o almacenamiento de Azure (recipientes) Job Submitter Component Map/reduce jobs on-the-fly for in-situ processing Transparente para el usuario final - no hay necesidad de aprender map / reduce Trabajos M / R ejecutados por Job Tracker de Hadoop Costo basado decisión cuando push computation vs direct import (basado en las estadísticas) (HDFS / WASB) Puente M-R Trabajo Peticionario EPA /Polybase Query Engine Tabla externa Datos externos fuente Formato de Archivo Externo PowerBI App Capa de almacenamiento optimizado PPAX - almacenamiento columnar fila híbrido Todos los formatos de archivo HDFS transformados en PPAX optimizado PolybaseCapa de almacenamiento (PPAX) 1 2 3

- 34. SQL Server en el nodo de control Aprovechando SQL Server como ayuda compilación de la consulta El usuario puede crear estadísticas sobre tabla externa Análisis completo vs. muestreo Decisión basada en el costo de empujar hacia abajo EPA /Polybase Engine de consultas utiliza estadísticas para determinar el volumen de datos a transferir Los factores de costo> IO y datos de costos de transferencia Suponiendo red de alta velocidad (> 10G Ethernet) Tabla externa Datos externos fuente Formato de Archivo Externo PowerBI Su App (HDFS / WASB) Puente M-R Trabajo Peticionario EPA /Polybase Query Engine PolybaseCapa de almacenamiento (PPAX) Repartido plan de consulta CREATE STATISTICS UserIP_Stats ON ClickStream(user_IP) WITH FULLSCAN Polybase- ejemplo create statistics Basada en el costo Decisión I (Para la ejecución de consultas basadas en split)

- 35. Principal factor de decisión es la reducción del volumen de datos Tiempo Spin-up time para Map Reduce es de alrededor de 20-30 segundos Spin-up varía dependiendo de la distribución de Hadoop y OS subyacente Cardinalidad de predicado es importante creación de estadísticas crucial para la calidad de planes de consulta Polybase No push down para escenarios donde APS puede ejecutar bajo 20-30 segundos sin push down "Regla empírica" - 'No considere pushdown para las entradas que se traduce en menos de 1 GB por * distribución PDW *' Ejemplo: Para 2 nodos de cálculo, archivo de tamaño> 16 GB Tabla externa Datos externos fuente Formato de Archivo Externo PowerBI Su App (HDFS / WASB) Puente M-R Trabajo Peticionario EPA /Polybase Query Engine PolybaseCapa de almacenamiento (PPAX) Decisión basada en el costo II (Para la ejecución de consultas basadas en split)

- 36. • Las consultas pueden tener push-able & non push-able expressions – Los Pusb-able serán evaluados en el lado Hadoop (si es posible) – El procesamiento de non-push se hará en el lado PDW • Los Joins en general será siempre ejecutado en APS – Los predicados puede ser push-downed (si es posible) • Las agregaciones (parciales o totales) se llevarán a cabo en PDW – Agregación parcial en Hadoop previsto para las futuras versiones de APS Tabla externa Datos externos fuente Formato de Archivo Externo PowerBI Su App (HDFS / WASB) Bridge M-R Job Sumitter EPA /Polybase Query Engine Polybase Capa de almacenamiento (PPAX) Basada en el costo Decisión III (Para la ejecución de consultas basadas en split)

- 37. Configuraciones compatibles para AU1 HDInsight en Analytics System Plataforma Almacenamiento blob de HDInsight Windows Azure (WASB [S]) Hortonworks en Windows Server (HDP 1.3, 2.0) Hortonworks en Linux (HDP 1.3, 2.0) Cloudera en Linux (CDH 4.3)

- 39. PDW en APS PDW con Polybase ¿Por qué Polybase?

- 41. El uso de Hadoop para Staging

- 42. ETL tradicional Data Warehousing y Business Intelligence Procesamient o de ETL (SSIS, etc)

- 43. Long Term Raw Data Archiving

- 44. Largo Plazo Raw Data Archiving

- 46. Nuevos tipos de datos

- 47. Ejemplos

- 49. CTAS – Create Table AS Select CREATE TABLE myTable WITH ( CLUSTERED COLUMNSTORE INDEX, DISTRIBUTION = HASH (CustomerKey) ) AS SELECT * FROM ClickStream;

- 50. El uso de sus datos conformados para enriquecer el análisis Hadoop

- 51. El uso de Hadoop para su Data Archive EDW

- 52. Data Archiving

- 53. Hadoop como un Archivo de Datos Procesamie nto de ETL Polybase

- 54. CETAS – Create External Table AS Select CREATE EXTERNAL TABLE hdfsFactAllDataArchive WITH ( LOCATION = 'hdfs://10.192.63.147:5000/files/AllData, FORMAT_OPTIONS ( FIELD_TERMINATOR = '|') ) AS SELECT * FROM FactAllData WHERE transaction_Year < 2000;

- 55. Join PDW & External Tables No Different from any other join you do today SELECT c.Name , d.Year , sum(sales) FROM FactSales s JOIN dimCustomer c ON c.CustomerID = s.CustomerID JOIN dimDate d ON s.DateID = d.DateID WHERE d.Year = 2008 AND c.Name = ‘Albertson & Brothers’ External Table Internal Table Internal Table

- 56. Polybase y su uso en la integración de almacenes de datos 29 de Abril (12 pm GMT -5) Juan M Rafael Resúmen: En esta sesión veremos cómo utilizar Polybase para integrar escenarios dentro un ambiente de Data Warehouse y fuentes heterogéneas de datos Próximo Evento